Modèles

Trooper.AI propose une variété de modèles logiciels préinstallés conçus pour accélérer la configuration de votre projet. Vous pouvez sélectionner un ou plusieurs modèles lors de la création de votre serveur GPU Blib, ou les ajouter ultérieurement via l'interface de gestion.

Important : Ne configurez pas manuellement le port ni ne créez un service système pour l'installation d'un modèle. Le modèle s'en charge automatiquement et gère ces éléments à chaque mise à jour !

⚠️🛡️ ATTENTION ! Si vous activez votre pare-feu et que les règles sont configurées de manière trop restrictive, l'installation des modèles peut échouer. Nous recommandons – pendant les installations de modèle – de réinitialiser le pare-feu aux paramètres par défaut. Un échec d'installation avec un pare-feu actif est un comportement attendu prouvant que celui-ci fonctionne correctement.

Comment ajouter un modèle

Sur votre serveur, cliquez sur le menu d'actions et sélectionnez « Ajouter un modèle » :

Dans la fenêtre contextuelle, cliquez simplement sur le nom du modèle souhaité :

Modifiez maintenant la configuration si nécessaire :

Démarrez l'installation avec le bouton bleu !

Répétez l'opération pour chaque modèle que vous souhaitez installer sur le serveur. Assurez-vous que le GPU dispose de suffisamment de VRAM pour gérer ces modèles et leurs modèles.

Démarrage/Arrêt et débogage d’une installation de modèle

Chaque modèle est géré comme un service système Ubuntu dédié, permettant un contrôle et un débogage faciles. Vous pouvez gérer ces services à l'aide de commandes Linux standard. Par exemple :

sudo service comfyui status

Cette commande récupère le statut actuel du modèle.

sudo service comfyui stop

Cette commande arrête le comfyui service. Substituer comfyui avec le nom du modèle que vous souhaitez gérer. Tous les modèles sont lancés par défaut.

Pour consulter le journal de service, y compris les 100 dernières entrées, utilisez la commande suivante :

sudo journalctl -u comfyui -f -n 100

Utilisez

journalctlpour déboguer efficacement les outils fonctionnant sur votre serveur GPU et identifier les problèmes potentiels.

Procédure d'installation du modèle

Le modèle passe par différentes couleurs indiquant l’état actuel du processus d’installation. Pour plus de détails, consultez la section Statut d’Installation des Modèles. Cependant, en général, il faut compter entre 3 et 10 minutes pour installer le modèle, selon la taille du téléchargement et les dépendances partagées déjà installées. Voici à quoi cela devrait ressembler une fois terminé :

Séparation des modèles pour le développement de l'IA

Les templates Trooper.AI sur votre serveur Blib vous permettent d'exécuter plusieurs applications d'IA ou différentes versions de la même application sur un seul serveur sans conflits. Considérez-les comme des conteneurs isolés pour chaque application.

Voici comment cela fonctionne :

- Isolation : Chaque modèle encapsule l'installation nécessaire pour une application d'IA spécifique. Cela signifie que toutes les bibliothèques requises, dépendances et paramètres restent isolés des autres applications sur le serveur.

- Environnements virtuels : Les modèles utilisent des environnements virtuels (comme

venvpour Python ouconda) afin de créer des espaces isolés pour les dépendances de chaque application. Cela évite les conflits qui peuvent survenir lorsque différentes applications nécessitent des versions distinctes d’une même bibliothèque. - Conteneurs Docker (Optionnel) : Pour une isolation et une portabilité encore plus poussées, les modèles peuvent utiliser des conteneurs Docker. Docker regroupe une application et toutes ses dépendances en une seule unité, garantissant ainsi son exécution de manière cohérente dans différents environnements.

- Données persistantes : Les modèles sont toujours configurés pour stocker les données de manière permanente, ce qui signifie que les données de votre application seront sauvegardées même si le serveur est mis en pause ou redémarré.

Cette approche offre plusieurs avantages :

- Organisation : Maintenir votre environnement de développement IA propre et organisé.

- Reproductibilité : Garantit des résultats cohérents en isolant les dépendances.

- Flexibilité : Permet de passer facilement d’une application IA à une autre ou d’expérimenter différentes versions.

- Efficacité des ressources : Optimise l'utilisation des ressources en exécutant plusieurs applications sur un seul serveur.

Modèles de serveurs Blib GPU préconfigurés

Voici un aperçu des modèles disponibles, chacun avec des informations détaillées fournies sur sa page de documentation dédiée :

Modèle ComfyUI pour les serveurs GPU Blibs

Une solution de flux de travail visuel et basée sur des nœuds pour Flux et Stable Diffusion, idéale pour la génération et le prototypage d'images IA avancées.

Serveur vLLM compatible avec OpenAI

Service rapide et facile de LLM à haut débit avec une API simple pour les environnements de production.

OpenWebUI & Ollama

Exécutez et gérez des modèles de langage volumineux (LLM) locaux, tels que LLaMA et Gemma, via une interface web conviviale et entièrement privée.

Framepack

Une solution basée sur l'IA qui transforme rapidement et efficacement les images en séquences vidéo fluides et cohérentes.

Environnement de bureau Ubuntu

Environnement de bureau Ubuntu complet accessible via xRDP, incluant des pilotes GPU fonctionnels, le navigateur Chrome et un support pour les applications nécessitant une carte graphique comme Blender ou DaVinci Resolve. Consultez également la section Accès RDP pour obtenir la meilleure connexion rapide à l'interface.

InvokeAI

Un éditeur d'images basé sur un navigateur avec des fonctionnalités avancées, notamment le multi-prompting, le téléchargement intégré des modèles Flux, et bien plus encore.

Automatic1111 pour SDXL

Déployez rapidement des flux de travail Stable Diffusion en utilisant la version compatible SDXL d'Automatic1111 – idéal pour la génération d'images de haute qualité à partir d'invites textuelles.

Cahier de Jupyter

Des notebooks Python interactifs entièrement accélérés par GPU, idéaux pour la science des données, les flux de travail d'apprentissage automatique et le prototypage rapide.

Qdrant

Base de données vectorielle évolutive conçue pour la recherche de similarité haute performance, permettant une récupération efficace pour les applications d'IA et l'analyse avancée des données.

n8n

Une plateforme d'automatisation de flux de travail sans code vous permettant de connecter des applications et d'automatiser des tâches - idéale pour la création de pipelines et d'intégrations d'IA personnalisés.

Tout Docker

Modèle flexible basé sur Docker pour lancer facilement des images Docker compatibles GPU.

Proxy web avec SSL

Le proxy web inclut un certificat SSL public, permettant un routage sécurisé du trafic sur Internet à partir d'un port interne.

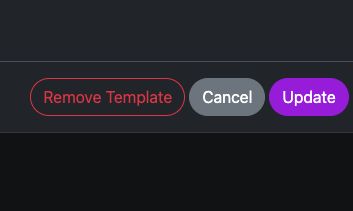

Supprimer un modèle

Vous pouvez supprimer un modèle en cliquant sur le bouton « Supprimer le modèle » dans sa configuration (accessible via l'icône d'engrenage sur la ligne d'installation du modèle dans le tableau de bord Blib – voir capture d'écran). Cette action supprime uniquement la configuration du modèle ; tout logiciel ou service associé reste intact et doit être supprimé manuellement. Vos données restent sécurisées tout au long de ce processus.

Demande de modèles supplémentaires

Si vous avez besoin de modèles supplémentaires ou de configurations personnalisées, veuillez contacter notre équipe d'assistance par e-mail ou WhatsApp, en incluant l'URL du dépôt GitHub pertinent. Notre équipe configurera rapidement l'environnement demandé.

Pour une assistance supplémentaire ou des demandes personnalisées, contactez-nous à : Contacts Support

🔒 Considérations relatives à l'authentification

Priorisez la sécurité de votre serveur. Bien que des applications comme OpenWebUI et n8n incluent des fonctionnalités d’authentification, ComfyUI et Automatic1111 proposent des options d’authentification configurables – consultez leur documentation officielle pour les détails de mise en œuvre. D’autres applications, telles qu'InvokeAI, peuvent ne pas disposer d’une authentification intégrée. N’oubliez pas : maintenir la sécurité de votre serveur reste de votre responsabilité. Pour toute question : Contacts Support