Jupyter Notebook

Ce modèle fournit un environnement Jupyter Notebook prêt à l'emploi, compatible GPU et préinstallé sur votre serveur Trooper.AI. Il est conçu pour une utilisation fluide, notamment pour les flux de travail de science des données, le développement de modèles d'IA, le prototypage et le calcul activé par CUDA.

Aperçu du modèle Jupyter Notebook

Une fois déployé, Jupyter Notebook s'exécute comme un service système sous l'utilisateur non-root. trooperaiLe service est toujours disponible après un redémarrage et ne nécessite aucune réactivation manuelle. Vous pouvez commencer à travailler immédiatement via l'interface basée sur le navigateur.

Fonctionnalités clés

- Environnement Python préinstallé utilisant virtualenv

- Support intégré des GPU avec installation optionnelle de CUDA/cuDNN

- Répertoire de travail persistant situé à

/home/trooperai - Lancement basé sur le service : Jupyter s'exécute en tant que service système et démarre automatiquement

- Accès avec ou sans jeton pour une sécurité simplifiée

- Upload de fichiers simple et intuitif vers votre serveur GPU Blib

- Terminal SSH dans votre navigateur avec plusieurs sessions simultanées

Accéder à Jupyter Notebook

Après le déploiement, votre GPU Server Blib attribue automatiquement un port public disponible. Pour accéder à Jupyter Notebook, ouvrez votre navigateur et naviguez vers :

http://your-hostname.trooper.ai:assigned-port

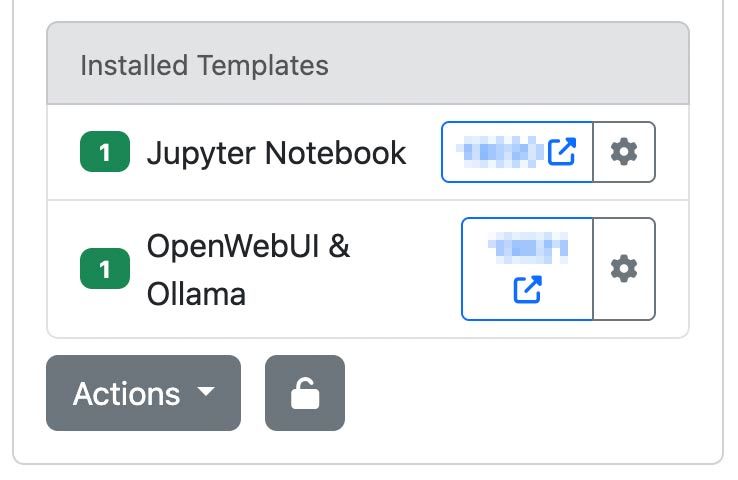

Vous trouverez le numéro de port attribué à côté du modèle dans les détails de votre serveur sur james.trooper.ai . Consultez cela ici :

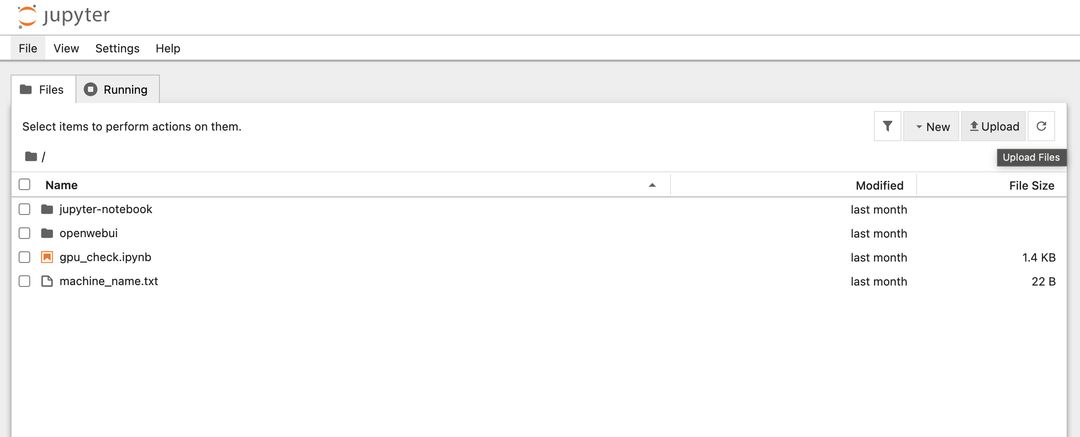

Après avoir cliqué sur le port, une nouvelle fenêtre de navigateur s'ouvrira et affichera la liste des fichiers du dossier personnel ou de l'espace de travail :

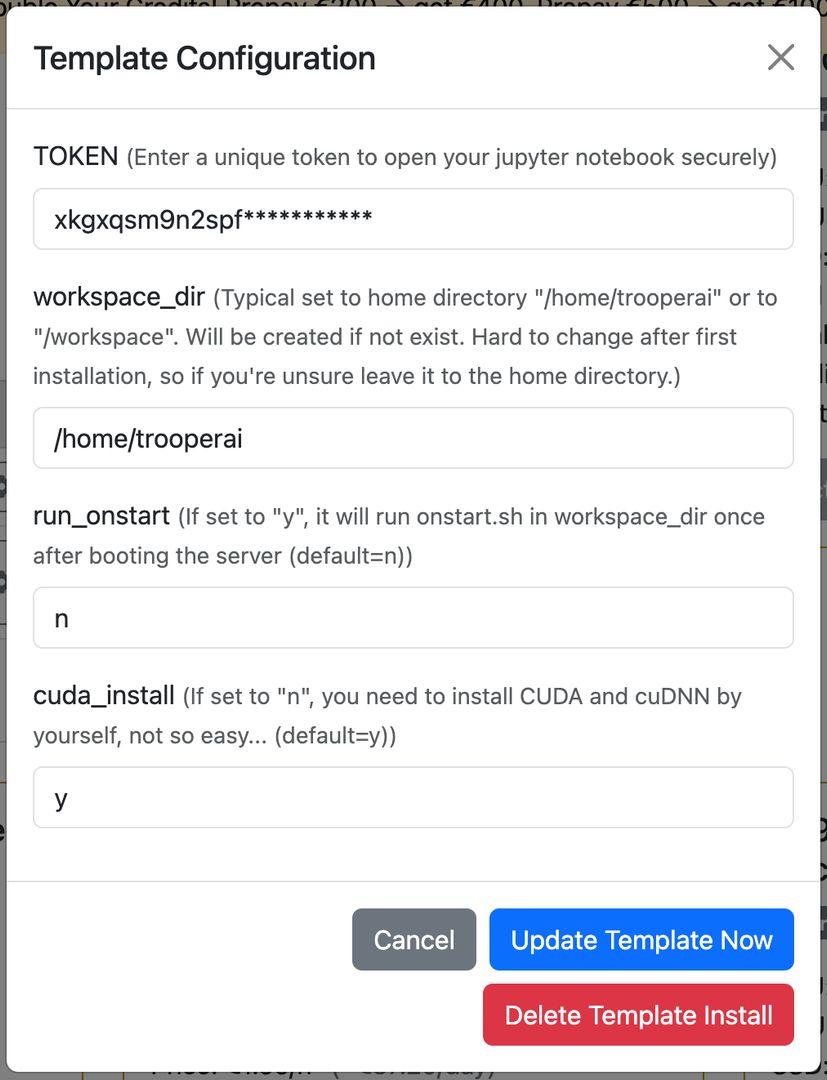

Si l'authentification par jeton est activée, l'interface vous demandera un jeton lors du premier accès. Sinon, le notebook sera directement accessible. Généralement, ce jeton est automatiquement ajouté à l'URL, vous n'avez donc pas à vous soucier de l'authentification. Vous pouvez modifier ou réinitialiser le jeton dans la Configuration du modèle.

Jupyter ouvre le répertoire suivant comme espace de travail racine :

/home/trooperai

Vous pouvez modifier ce paramètre dans la Configuration du modèle, voir ici :

Nous recommandons le dossier personnel de l'utilisateur (par défaut) ou /workspace.

Vous pouvez également activer l'exécution automatique de onstart.sh dans votre dossier de travail au démarrage du serveur pour lancer votre application.

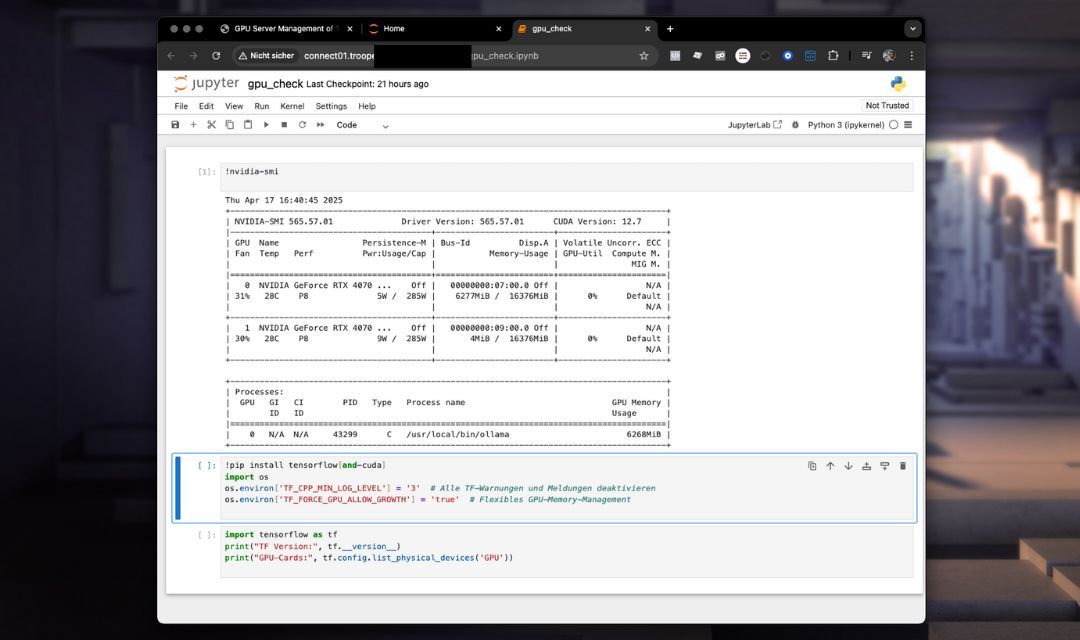

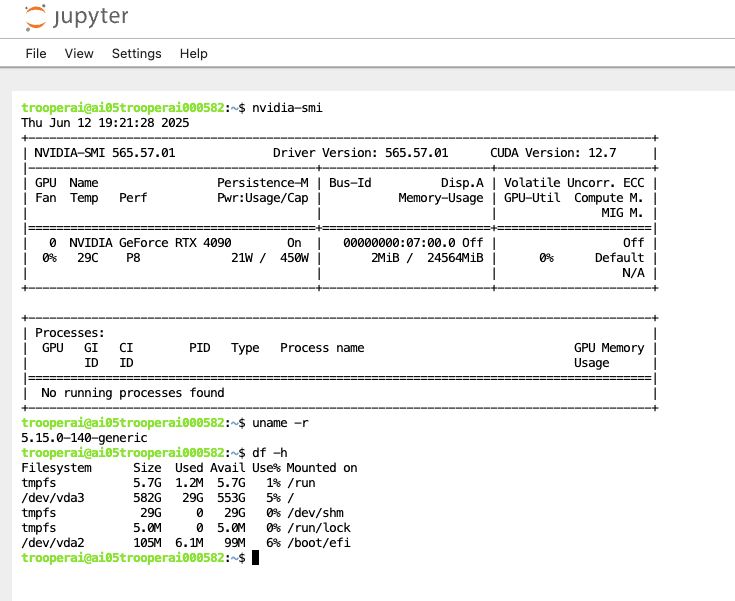

Vérification du GPU et prise en charge de CUDA

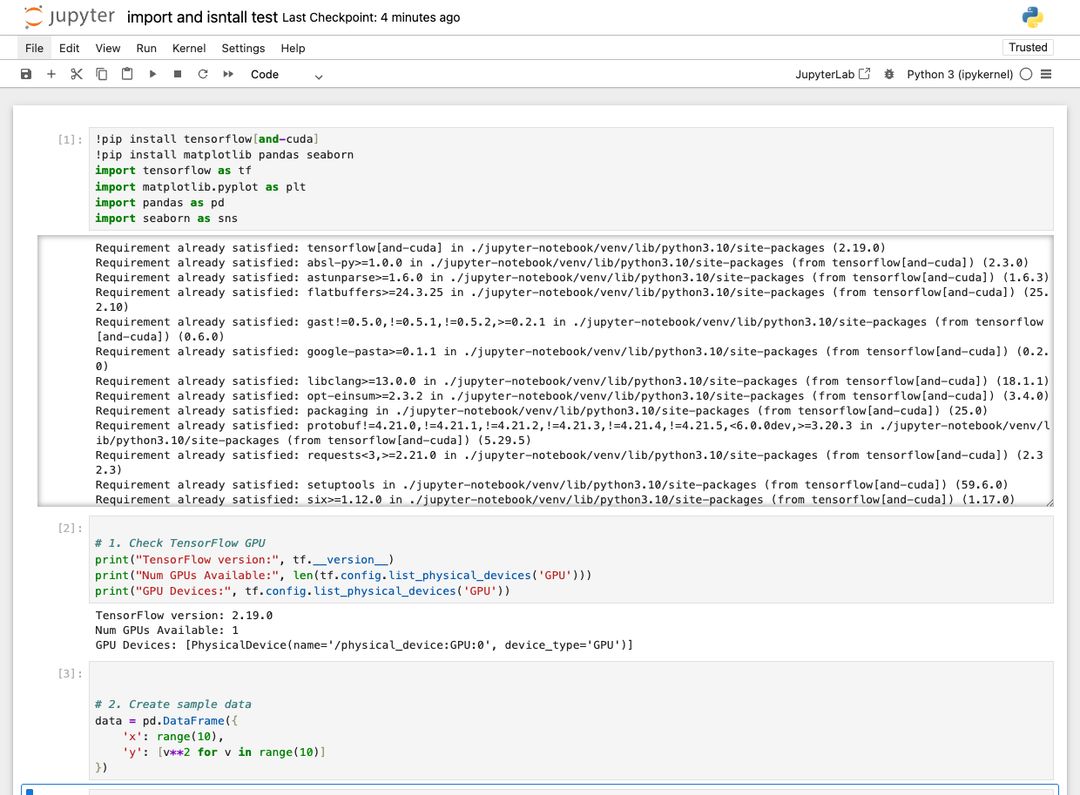

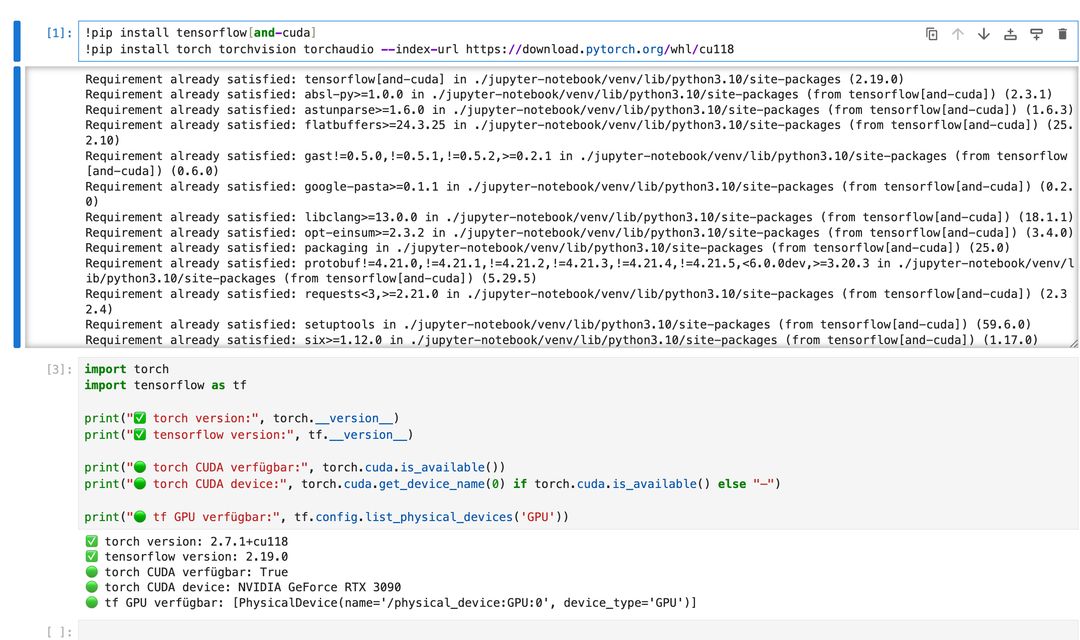

Le modèle inclut un notebook nommé gpu_check.ipynb pour vérifier la disponibilité du GPU et la configuration de TensorFlow. Il installe également tous les outils nécessaires pour l'utilisation de CUDA en Python.

Exemple de contenu de gpu_check.ipynb:

!nvidia-smi

!pip install tensorflow[and-cuda]

import os

os.environ['TF_CPP_MIN_LOG_LEVEL'] = '3'

os.environ['TF_FORCE_GPU_ALLOW_GROWTH'] = 'true'

import tensorflow as tf

print("TF Version:", tf.__version__)

print("GPU-Cards:", tf.config.list_physical_devices('GPU'))

Vous pouvez étendre ceci pour utiliser d'autres frameworks tels que PyTorch ou JAX.

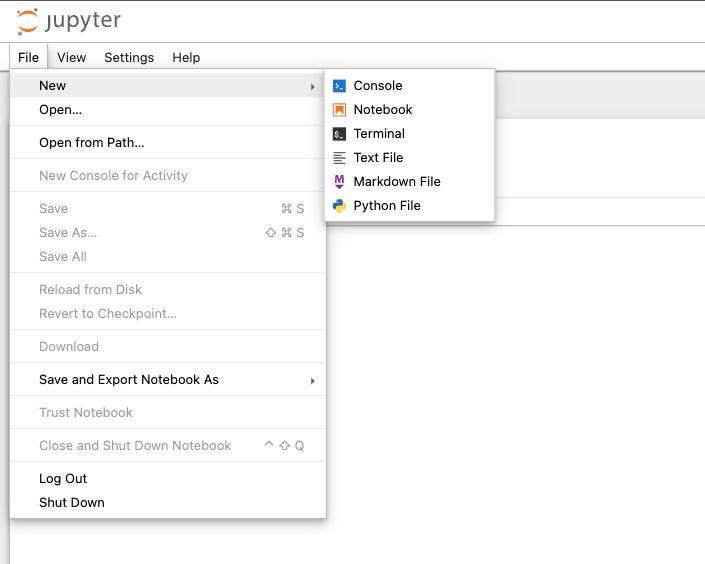

Terminal dans le navigateur

Vous pouvez simplement démarrer une session de terminal dans un Jupyter Notebook qui est persistante jusqu’au redémarrage ! À quel point c’est génial ? Même si vous fermez le navigateur, elle reste là en cours d’exécution dans ce terminal comme bon vous semble. Très utile. Allez dans FICHIER > NOUVEAU > TERMINAL comme ici :

Vous verrez une fenêtre de terminal avec un shell interactif comme ceci :

Nous utilisons souvent cette fonctionnalité pour vérifier rapidement quelque chose sur le serveur GPU.

Ces sessions de terminal continuent de fonctionner même si vous fermez votre navigateur – il n'est pas nécessaire d'utiliser des outils comme

nohubC keeping the valuable: KEEP the Valuable and keep p Keep Keep Keep and Keep This the KEEP and ThisKeep This Keep Keep the valuable KEEP This Keep This Keep Keep keeping the Keep Keep the Keep Keep the KeepKeep theKeep Keep the KeepKeep This KeepKeep KeepKeepThis Keep KeepKeeping KeepKeepKeepKeep Keep This KeepKeep Keep Keep valuableKeepKeeping KeepKeep the KeepKeepKeepKeep Keep KeepKeepKeep Keep KeepKeepKeep Keep KeepKeep Keep Keep the Keep This Keep Keep Keeping Keep KeepKeep Keep This Keep KeepKeep Keep KeepKeepKeep the Keep Keep Keep Keep KeepKeepKeep this Keep Keep this Keep Keep this Keep Keep This Keep KeepThisKeepKeepThis Keep Keep ThisKeepKeepThis KeepKeepThis KeepKeepThisKeep KeepKeepThisKeepKeepThis KeepKeepThis KeepKeepThis KeepKeepThis KeepKeepThis KeepKeepThis KeepKeepThis KeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepKeepThisKeepThisKeepKeepThisKeepThisKeepKeepThisKeepThisKeepThisKeepKeepThisKeepThisTo stop writing unnecessary. Therefore,To keep your information for the time being,To make aTo10,Please.

Cas d'utilisation recommandés

- Exploration et visualisation de données

- Prototypage d'apprentissage profond et automatique

- Flux de travail de formation basés sur le GPU

- Enseignement et ateliers

- Télécharger et télécharger des fichiers sur le serveur GPU

Importer et installer de l'aide

Si vous avez besoin d'installer des bibliothèques supplémentaires dans votre Jupyter Notebook, utilisez simplement la commande !pip install comme ceci : !pip install commande comme ceci :

Cela vérifiera toujours si tout est installé et, sinon, le fera.

Important : Assurez-vous toujours d'installer TensorFlow avec CUDA comme suit : !pip install tensorflow[and-cuda]. Sinon, cela ne fonctionnera pas avec la GPU.

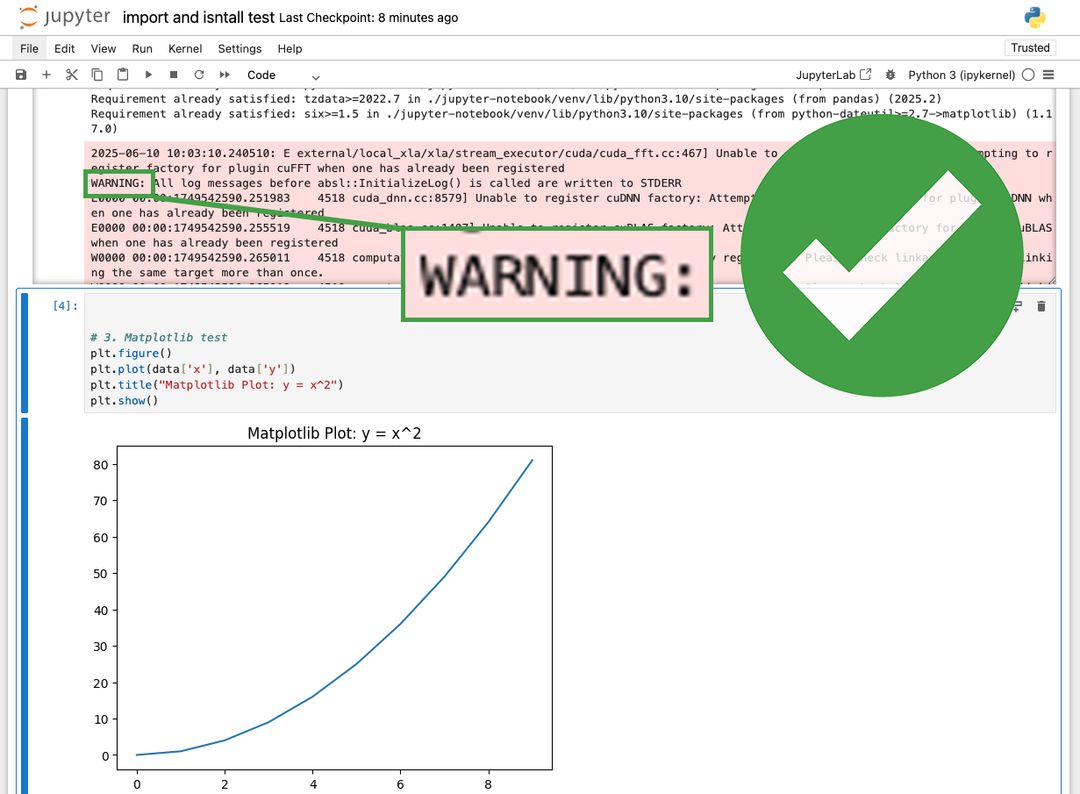

J'ai reçu des avertissements ?

Il y a toujours des avertissements en rouge dans Jupyter Notebook. Ceux-ci ne sont généralement pas un problème. Voir ici :

Vous devriez examiner cela et vérifier si un avertissement concerne l'utilisation du GPU et vérifier qu'il ne réduit pas les performances. Vous pouvez également désactiver les avertissements, mais cela dépend de la bibliothèque et peut être difficile. Nous recommandons de s'y tenir.

Détails du système

Configuration par défaut

- Interface Jupyter Notebook sur un port attribué automatiquement

- Environnement virtuel Python

~/jupyter-notebook/venv - Répertoire de travail :

/home/trooperai - Démarre automatiquement après le redémarrage

Pile GPU optionnelle

Si votre instance a CUDA installé, Jupyter détectera automatiquement le support GPU. CUDA 12.8 et cuDNN 9.8 sont disponibles avec la compatibilité TensorFlow.

Personnalisation et script de démarrage

Un fichier nommé onstart.sh est inclus dans votre espace de travail. Il peut être modifié pour exécuter des commandes shell personnalisées à chaque redémarrage du système. Pour l'activer, contactez l'assistance afin d'activer l'exécution de onstart.

Q&A

❓ Comment installer à la fois PyTorch et TensorFlow avec le support GPU en utilisant pip?

✅ Réponse :

TensorFlow et PyTorch doivent être installés séparément pour éviter les conflits de dépendances CUDA. Voici la méthode recommandée en utilisant pip :

# Install TensorFlow with GPU support

!pip install tensorflow[and-cuda]

# Then install PyTorch with CUDA 11.8 (example)

!pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

Ne combinez pas les deux dans une seule commande pip comme ceci :

# ❌ Not recommended — may cause conflicts!

!pip install torch tensorflow[and-cuda]

Installez-les séparément, dans l'ordre correct.

Après l'installation, testez la disponibilité du GPU dans votre notebook :

import torch, tensorflow as tf

print("Torch CUDA:", torch.cuda.is_available())

print("TF GPUs:", tf.config.list_physical_devices('GPU'))

❓ Comment installer des paquets via pip via le terminal pour l'utiliser dans Jupyter Notebook ?

✅ Réponse :

Votre carnet Jupyter (environnement virtuel Python dédié) a été configuré ! Vous devez donc exécuter la commande pip depuis cet environnement dans le terminal. Par exemple :

/home/trooperai/jupyter-notebook/venv/bin/pip install tensorflow[and-cuda]

Pour activer l'environnement et installer de manière interactive :

source /home/trooperai/jupyter-notebook/venv/bin/activate

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

Après l'installation, redémarrez le noyau de votre notebook pour rendre les nouveaux paquets disponibles.

Support

Pour obtenir de l'aide à l'installation, à la récupération de jetons ou au dépannage de l'espace de travail, veuillez contacter :

- Email : [email protected]

- WhatsApp : +49 6126 9289991