Jupyter Notebook

Deze template biedt een kant-en-klare, GPU-geschikte Jupyter Notebook omgeving die vooraf is geïnstalleerd op uw Trooper.AI server. Het is ontworpen voor naadloos gebruik, inclusief data science workflows, AI modelontwikkeling, prototyping en CUDA-compatibele berekeningen.

Overzicht Jupyter Notebook Sjabloon

Zodra het is geïmplementeerd, wordt Jupyter Notebook uitgevoerd als een systeemservice onder de niet-root gebruiker. trooperaiDe service is altijd beschikbaar na een herstart en vereist geen handmatige reactivering. U kunt direct aan de slag via de browserinterface.

Belangrijkste kenmerken

- Vooraf geïnstalleerde Python-omgeving met virtualenv

- Geïntegreerde GPU-ondersteuning met optionele installatie van CUDA/cuDNN

- Duurzaam werkdirectory gelegen op

/home/trooperai - Opstart als systeemdienst: Jupyter draait als een systeemdienst en start automatisch

- Toegang met of zonder token voor vereenvoudigd beveiligingsbeheer

- Gemakkelijke bestandsoverdracht naar uw GPU Server Blib

- SSH-terminal in uw webbrowser met meerdere gelijktijdige sessies

Toegang tot Jupyter Notebook

Na implementatie wijst uw GPU Server Blib automatisch een beschikbare openbare poort toe. Om toegang te krijgen tot Jupyter Notebook, opent u uw browser en navigeert u naar:

http://your-hostname.trooper.ai:assigned-port

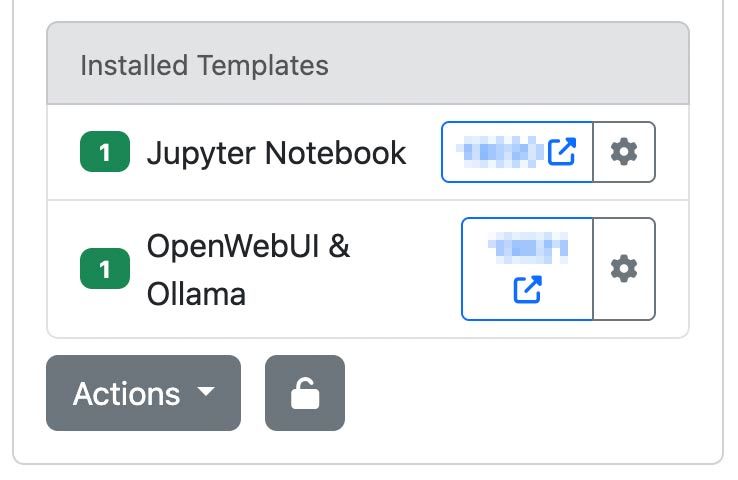

Je vindt het toegewezen poortnummer naast de sjabloon in je serverdetails op james.trooper.ai . Zie hier hoe:

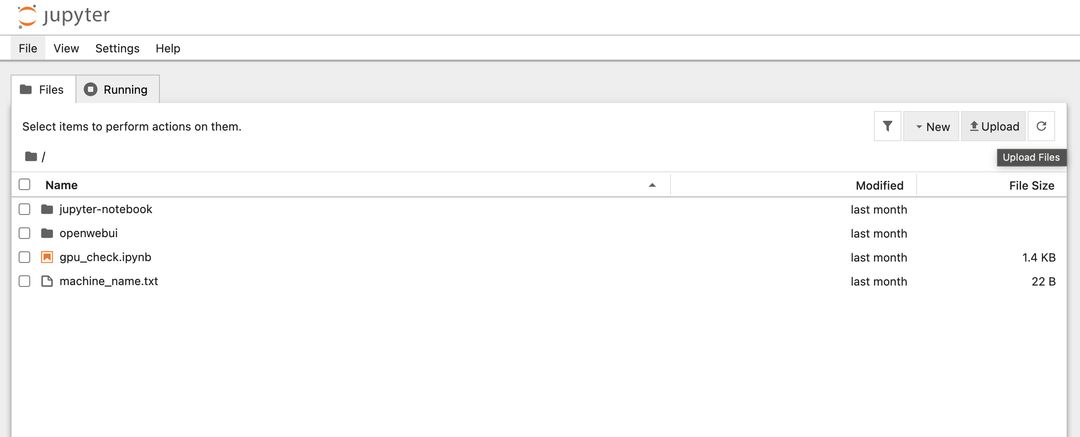

Nadat u op de poort heeft geklikt, wordt een nieuw browservenster geopend met de bestandslijst van de home- of werkruimtemap:

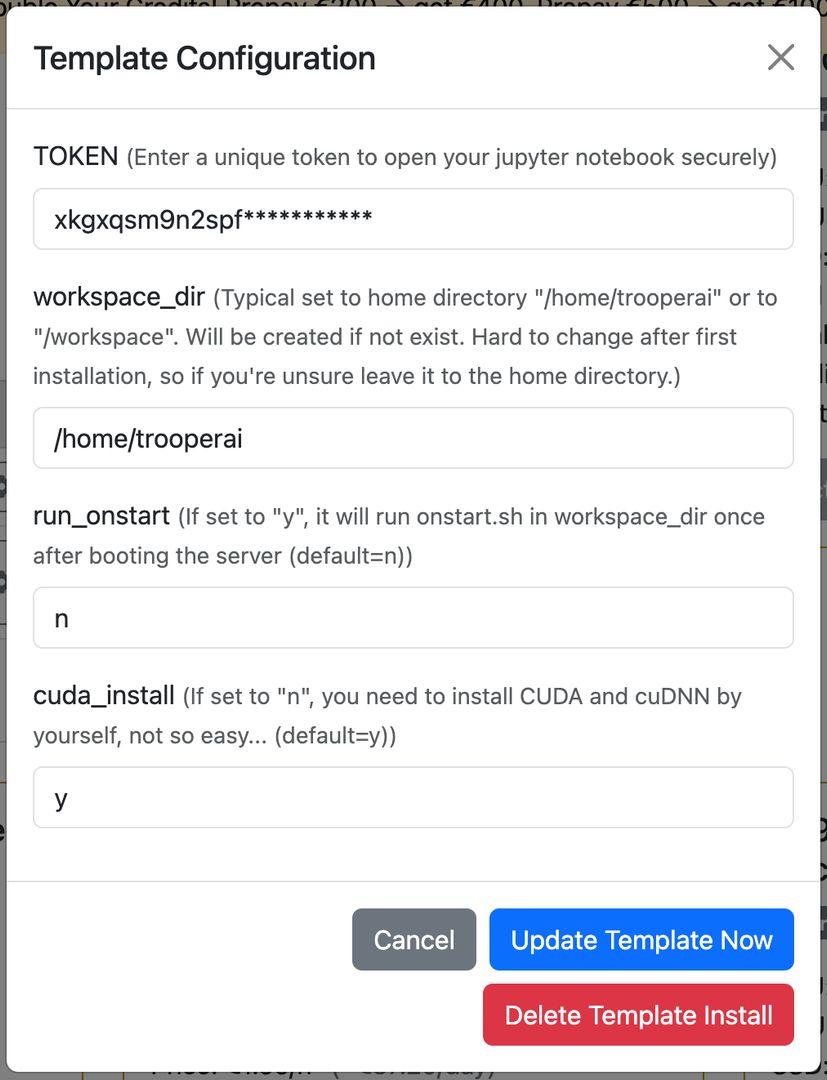

Als tokenauthenticatie is ingeschakeld, zal de interface om een token vragen bij de eerste toegang. Anders is het notebook direct beschikbaar. Meestal wordt dit token automatisch aan de URL toegevoegd, zodat u zich geen zorgen hoeft te maken over authenticatie. U kunt het token wijzigen of resetten in de Template Configuratie.

Jupyter opent de volgende map als zijn hoofdwerkruimte:

/home/trooperai

Je kunt dit wijzigen in de Template Configuration, zie hier:

We raden de home map van de gebruiker (standaard) of /workspace aan.

Je kunt ook de automatische uitvoering activeren van onstart.sh in je werkmap bij het opstarten van de server om je app te starten.

GPU-verificatie en CUDA-ondersteuning

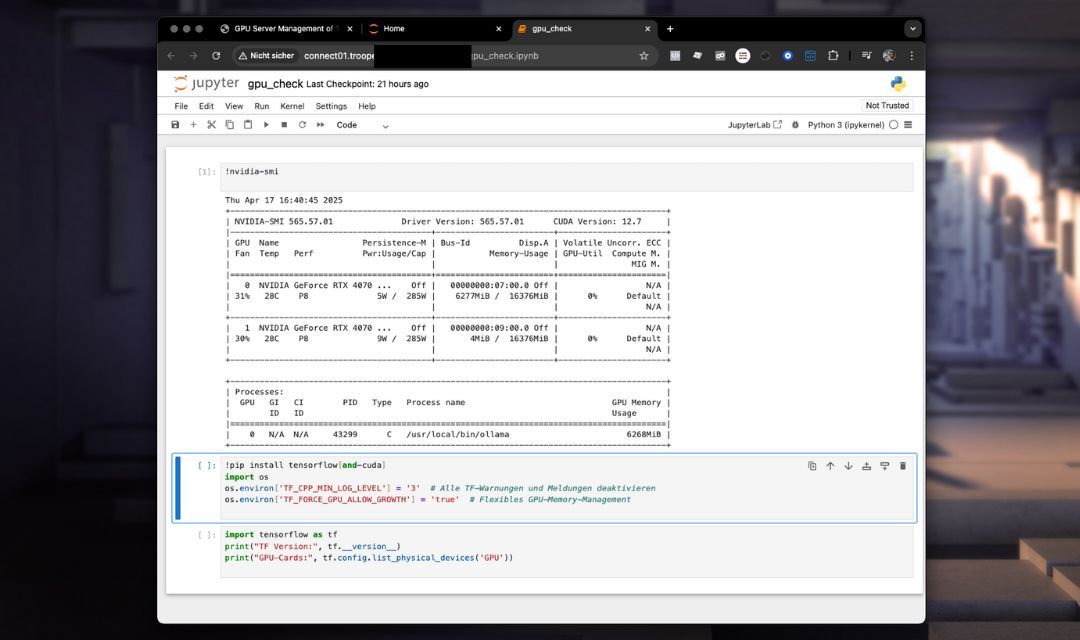

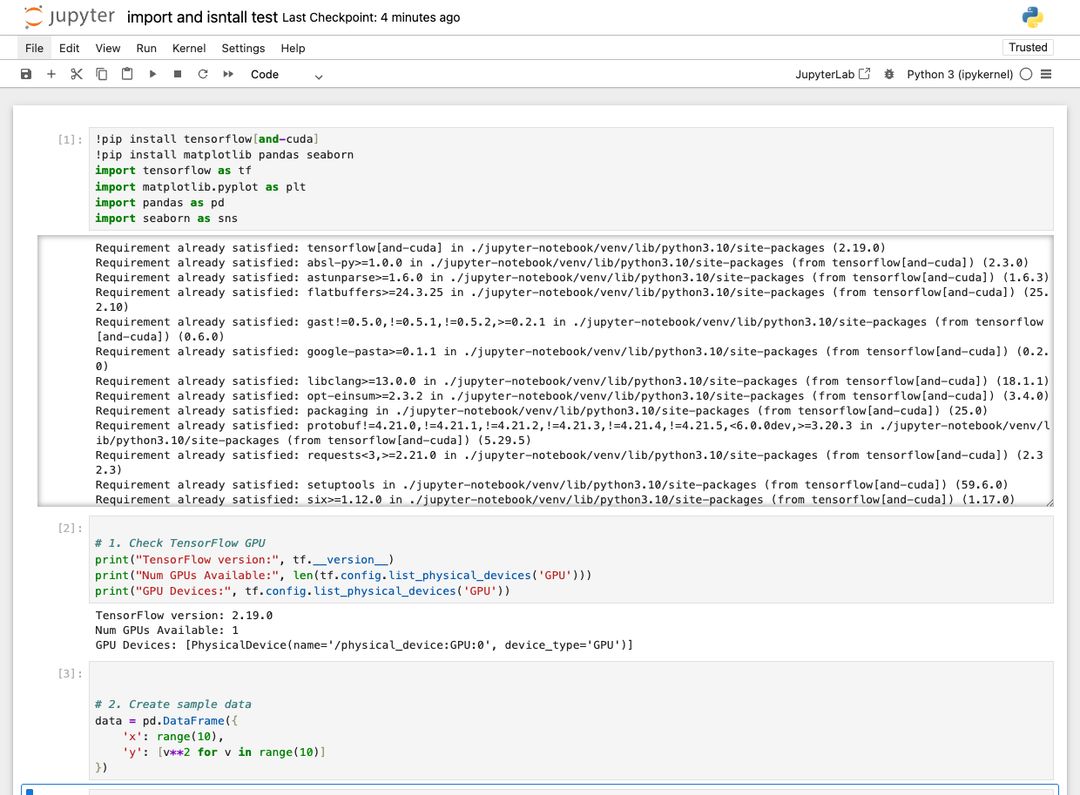

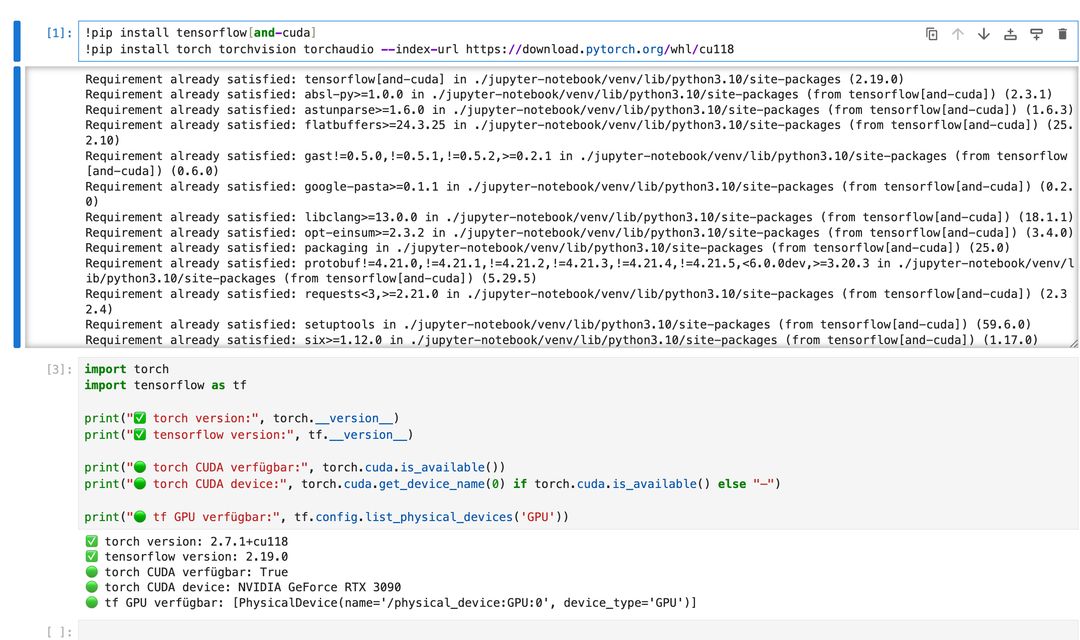

De template bevat een notebook genaamd gpu_check.ipynb om de GPU-beschikbaarheid en TensorFlow-installatie te verifiëren. Het installeert ook alle benodigde tools voor CUDA-gebruik in Python.

Voorbeeld inhoud van gpu_check.ipynb:

!nvidia-smi

!pip install tensorflow[and-cuda]

import os

os.environ['TF_CPP_MIN_LOG_LEVEL'] = '3'

os.environ['TF_FORCE_GPU_ALLOW_GROWTH'] = 'true'

import tensorflow as tf

print("TF Version:", tf.__version__)

print("GPU-Cards:", tf.config.list_physical_devices('GPU'))

Je kunt dit uitbreiden om andere frameworks te gebruiken, zoals PyTorch of JAX.

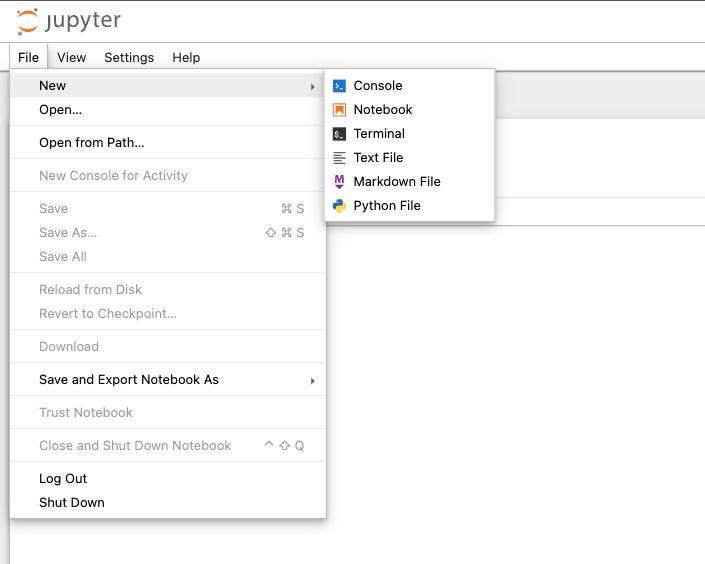

Terminal in de Browser

Je kunt eenvoudig een persistent terminalsessie in Jupyter Notebook opstarten die blijft draaien tot herstart! Hoe handig is dat wel? Zelfs als je de browser sluit, loopt het nog steeds door in die terminal wat je maar wilt. Zeer nuttig. Ga naar BESTAND > NIEUW > TERMINAAL zoals hier:

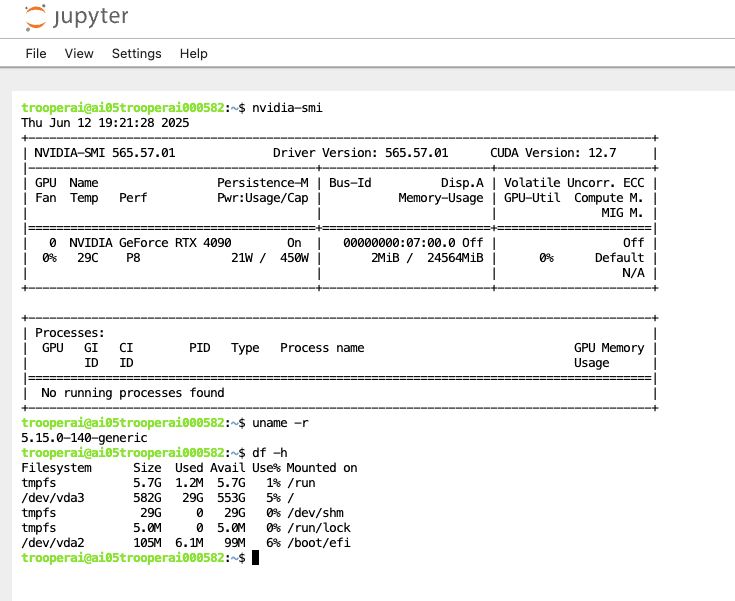

U ziet een terminalvenster met een interactieve shell zoals dit:

We gebruiken dit vaak om snel iets op de GPU-server te controleren.

Deze terminal sessies blijven actief, zelfs als je je browser sluit – je hebt geen tools zoals nohub nodig om processen draaiende te houden.

nohubom processen draaiende te houden. Bovendien wordt alle uitvoer opgeslagen, waardoor prototyping gemakkelijker wordt zonder waardevolle informatie te verliezen.

Aanbevolen toepassingsgebieden

- Dataverkenning en visualisatie

- Prototype van deep learning en machine learning

- GPU-gestuurde trainingsworkflows

- Onderwijs en workshops

- Bestanden uploaden en downloaden naar de GPU-server

Importeren en installatiehulp

Als je extra bibliotheken in je Jupyter Notebook wilt installeren, gebruik dan gewoon de !pip install zoals dit commando:

Dit controleert altijd of alles is geïnstalleerd en zo niet, dan zal het dat doen.

Belangrijk: Zorg er altijd voor dat je TensorFlow installeert met CUDA, zoals hieronder: !pip install tensorflow[and-cuda]. Anders werkt het niet met de GPU.

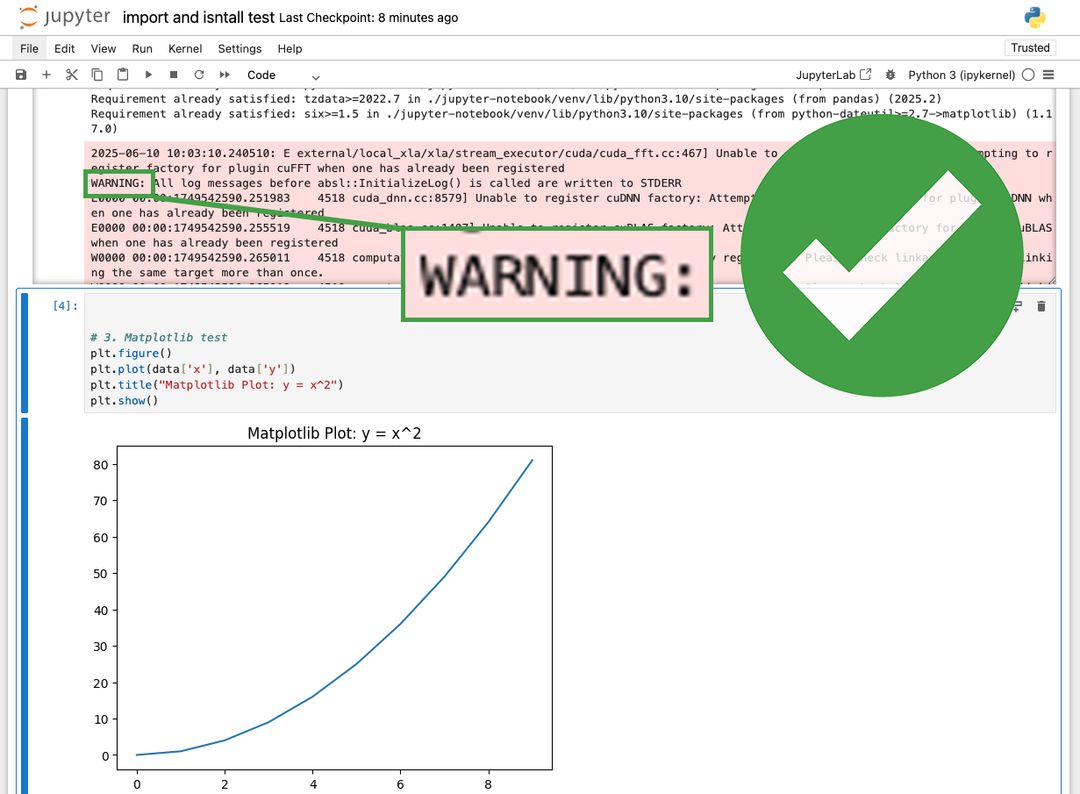

Ik kreeg Waarschuwingen?

Er zijn altijd enkele waarschuwingen die rood gekleurd zijn in Jupyter Notebook. Deze zijn meestal geen probleem. Zie hier:

Je zou dit moeten onderzoeken en controleren of een waarschuwing betrekking heeft op GPU-gebruik en of dit de prestaties niet vermindert. Je kunt ook waarschuwingen uitschakelen, maar dit is afhankelijk van de bibliotheek en kan soms lastig zijn. We raden aan om ze gewoon te laten staan.

Systeemdetails

Standaardconfiguratie

- Jupyter Notebook interface op een automatisch toegewezen poort

- Python virtuele omgeving in

~/jupyter-notebook/venv - Werkmap:

/home/trooperai - Start automatisch op na herstart

Optionele GPU-stack

Als uw instantie CUDA heeft geïnstalleerd, zal Jupyter automatisch GPU-ondersteuning detecteren. CUDA 12.8 en cuDNN 9.8 zijn beschikbaar met TensorFlow-compatibiliteit.

Aanpassing & Opstartscript

Een bestand genaamd onstart.sh is opgenomen in uw werkruimte. Het kan worden aangepast om aangepaste shell-opdrachten uit te voeren bij elke systeemherstart. Neem contact op met de support om de uitvoering van onstart in te schakelen.

Q&A

❓ Hoe kan ik zowel PyTorch als TensorFlow installeren met GPU-ondersteuning met pip?

✅ Antwoord:

TensorFlow en PyTorch moeten apart geïnstalleerd worden om CUDA-afhankelijkheidsconflicten te vermijden. Hier volgt de aanbevolen methode met behulp van pip:

# Install TensorFlow with GPU support

!pip install tensorflow[and-cuda]

# Then install PyTorch with CUDA 11.8 (example)

!pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

Kombineer ze niet in één enkele pip-opdracht zoals hieronder:

# ❌ Not recommended — may cause conflicts!

!pip install torch tensorflow[and-cuda]

Afzonderlijk installeren, in de juiste volgorde.

Na installatie, test je de GPU-beschikbaarheid in je notebook:

import torch, tensorflow as tf

print("Torch CUDA:", torch.cuda.is_available())

print("TF GPUs:", tf.config.list_physical_devices('GPU'))

❓ Hoe installeer ik pakketten via pip via de terminal om te gebruiken in het Jupyter Notebook?

✅ Antwoord:

Je Jupyter Notebook is ingesteld met een apart Python virtueel omgeving. Je moet daarom pip vanuit die omgeving in het terminal uitvoeren. Bijvoorbeeld:

/home/trooperai/jupyter-notebook/venv/bin/pip install tensorflow[and-cuda]

Om de omgeving te activeren en interactief te installeren:

source /home/trooperai/jupyter-notebook/venv/bin/activate

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

Na de installatie, herstart je notebook kernel om de nieuwe pakketten beschikbaar te maken.

Ondersteuning

Neem contact op voor installatieondersteuning, tokenherstel of werkruimteprobleemoplossing:

- E-mail: [email protected]

- WhatsApp: +49 6126 9289991