OpenWebUI & Ollama

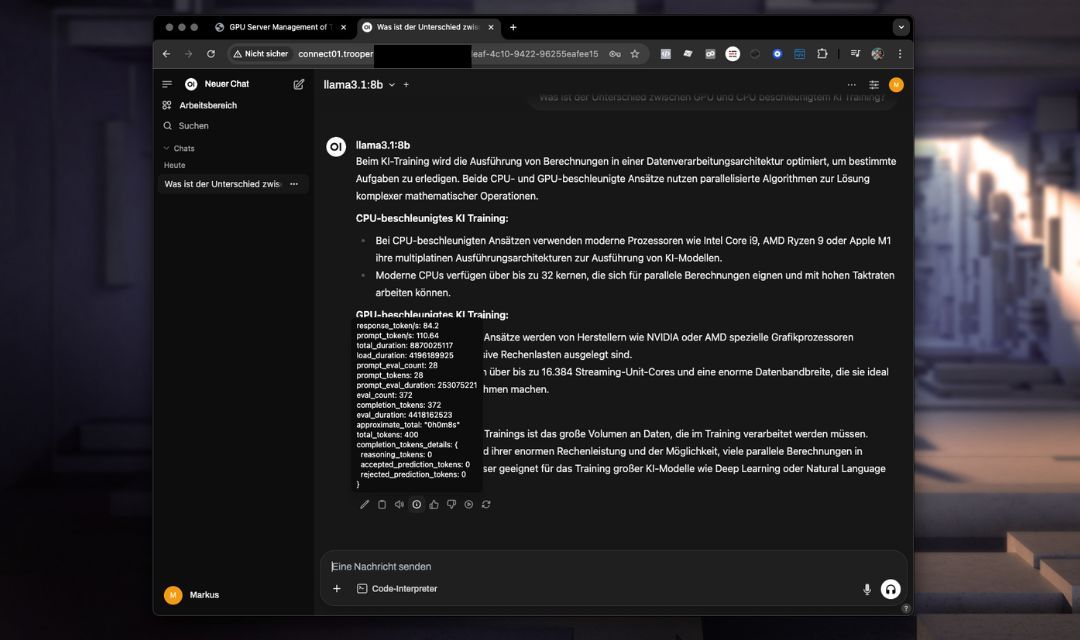

OpenWebUI & Ollama-Vorlage bietet eine vorkonfigurierte, selbstgehostete KI-Chat-Schnittstelle mit direkter Integration leistungsstarker Sprachmodelle wie Llama oder DeepSeek über Ollama . Diese umfasst eine optimierte Einrichtung für nahtlosen Betrieb ohne zusätzliche Konfiguration.

Diese Vorlage nutzt die erweiterten API-Funktionen von OpenWebUI und bietet so eine verbesserte Gesprächsverwaltung, Kontextpersistenz und eine optimierte Integration im Vergleich zur einfacheren API von Ollama.

Sie können die zu installierende Version von OpenWebUI angeben. Der Standardwert ist unsere zuletzt getestete Version, aber Sie können bei Bedarf upgraden oder downgraden. Geben Sie einfach Ihre gewünschte Version beim Wert der Konfiguration während der Template-Installation ein.

Hauptfunktionen und -fähigkeiten

- Erweiterte Web-Oberfläche: Intuitives Chat-Erlebnis direkt über Ihren Browser zugänglich.

- Erweiterte API-Funktionen: Verbesserte Verwaltung von Chat-Kontexten sowie einfachere Integration mit externen Anwendungen.

- Optimierte Modellnutzung: Vorgeinstallierte Modelle für sofortige Nutzung bereit.

- Integrierte Umgebung: Vollständig vorkonfigurierte Umgebung mit Port-Einstellungen und allen notwendigen Konfigurationen.

- Sicher und Anpassbar: Einfache Einrichtung für sichere Anmeldedaten sowie nutzerspezifische Konfigurationen.

Installation

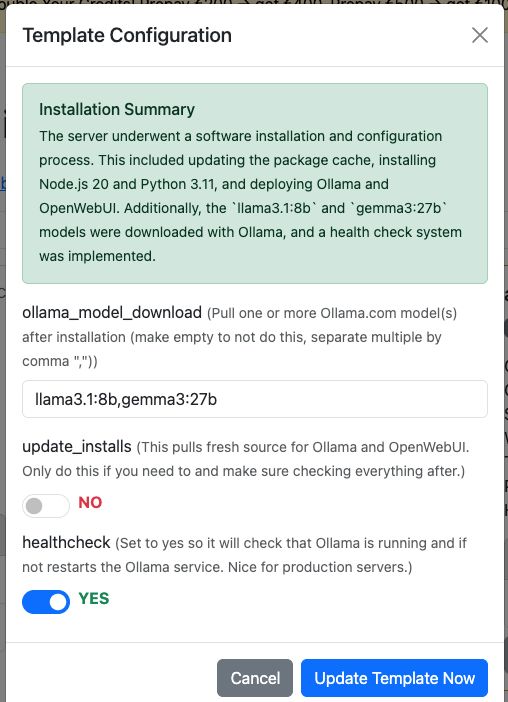

Fügen Sie einfach die Vorlage „OpenWebUI & Ollama“ zu Ihrem Trooper.AI GPU Server hinzu und die Installation erfolgt vollständig automatisch. Wenn Sie möchten, kann es Ihre Modelle auch direkt von ollama herunterladen. Sie können diese im Vorlagenkonfigurationsdialog konfigurieren.

Sie können Modelle natürlich auch nach der Installation über die OpenWebUI herunterladen.

Zusätzliche Optionen:

Aktualisierungen durchführen:

Diese Option lädt die neueste Version von Ollama und OpenWebUI herunter. Nutzen Sie diese nur bei Bedarf und prüfen Sie anschließend alles sorgfältig.

Natürlich können Sie auch manuell über das Terminal aktualisieren – denken Sie jedoch daran, Abhängigkeiten ebenfalls zu installieren.

Diese Funktion erledigt alles für Sie – bequem und automatisiert!Gesundheitsprüfung aktivieren:

Stellen Sie dies aufjaein, um eine Gesundheitsprüfung zu aktivieren, die sicherstellt, dass der Ollama-Dienst läuft und über seine interne API antwortet.

Falls nicht, startet die Gesundheitsprüfung den Dienst automatisch neu.

Das Skript befindet sich unter/usr/local/bin/ollama-health.sh. Der Dienst lässt sich mit Folgendem steuern:

sudo service ollama-health stop/start/status.

Dies ist besonders für Produktionsserver nützlich.

Zugriff auf OpenWebUI

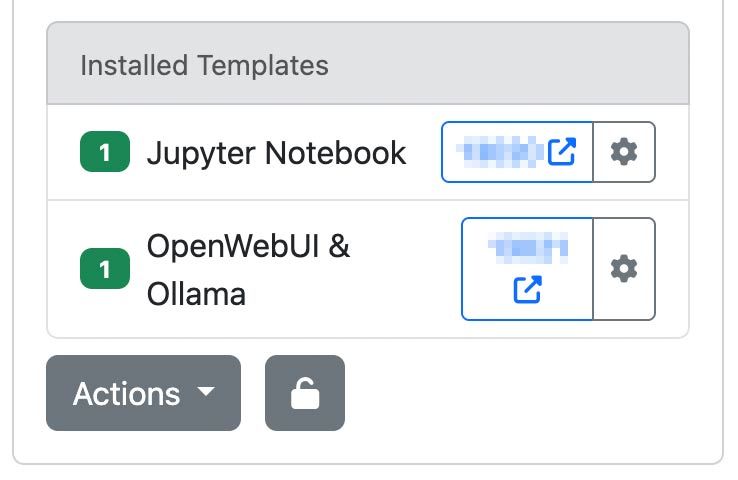

Nach dem Bereitstellen Ihrer Trooper.AI Serverinstanz mit der OpenWebUI & Ollama Vorlage, greifen Sie über die zugewiesene URL und den Port darauf zu:

http://your-hostname.trooper.ai:assigned-port

Oder klicken Sie auf die blaue Portnummer neben der OpenWebUI-Vorlage:

Sie konfigurieren die anfänglichen Anmeldedaten bei der ersten Verbindung. Stellen Sie sicher, dass Sie diese Anmeldedaten sicher aufbewahren, da sie für den späteren Zugriff erforderlich sind.

Empfohlene Anwendungsfälle

Die OpenWebUI & Ollama Vorlage eignet sich ideal für:

- Teamkollaboration via KI-Chat

- Bereitstellungen persönlicher KI-Assistenten

- Schnelle Entwicklung und Prototypenerstellung von Konversations-KI-Anwendungen

- API-Nutzung und Agenten-Erstellung/Verbindung als Ersatz für die OpenAI-API

- Bildungs- und Forschungszwecke

LLMs, die Sie testen sollten

Unserer Meinung nach sind hier ein paar Modelle, mit denen Sie beginnen können:

- GPT-OSS: Ein offenes Modell von OpenAI mit Gewichten für logisches Denken (

reasoning ), agile Aufgaben sowie Entwicklung. Läuft effizient auf Instanzen wie Explorer, Conqueror (mit 16 GB VRAM) und Sparbox (mit 24 GB VRAM). https://ollama.com/library/gpt-oss:20b - DeepSeek-R1: Ein leistungsstarkes offenes Modell für logisches Schließen, das mit O3 und Gemini 2.5 Pro vergleichbar ist. Optimiert für StellarAI-Maschinen mit 48 GB VRAM. https://ollama.com/library/deepseek-r1:70b

- Gemma 3: Aktuell eines der leistungsfähigsten Modelle für den Einsatz auf einer einzelnen GPU. Betreibt Trooper.AIs James auf Sparbox-Instanzen. https://ollama.com/library/gemma3:27b

Mehr LLMs finden Sie hier: https://ollama.com/search (Alle sind mit OpenWebUI kompatibel!)

Technische Überlegungen

Systemanforderungen

Stellen Sie sicher, dass die VRAM-Auslastung Ihres Modells 85 % nicht überschreitet, um eine erhebliche Leistungsverschlechterung zu vermeiden.

- Empfohlene GPU-VRAM: 24 GB

- Speicher: Mindestens 180 GB verfügbarer Speicherplatz

Vorkonfigurierte Umgebung

- Ollama und OpenWebUI sind vorinstalliert und vollständig integriert.

- Porteinstellungen und alle notwendigen Konfigurationen sind bereits vorgenommen, sodass keine weitere manuelle Einrichtung erforderlich ist.

- Installationsverzeichnisse und Umgebungsvariablen sind vorkonfiguriert und sofort einsatzbereit.

Datenspeicherung

Alle Chat-Interaktionen, Modelleinstellungen und Benutzereinstellungen werden sicher auf Ihrem Server gespeichert.

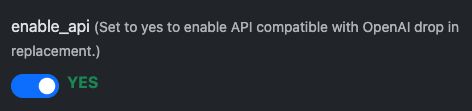

Verbindung über eine OpenAI-kompatible API

OpenWebUI bietet eine OpenAI-kompatible API-Schnittstelle, die eine nahtlose Integration mit Tools und Anwendungen ermöglicht, die das OpenAI-Format unterstützen. Dies ermöglicht Entwicklern die Interaktion mit selbst gehosteten Modellen wie llama3 als ob sie mit der offiziellen OpenAI-API kommunizieren – ideal, um Konversations-KI in Ihre Dienste, Skripte oder Automatisierungsabläufe einzubetten.

Erste Schritte: Vorbereitung

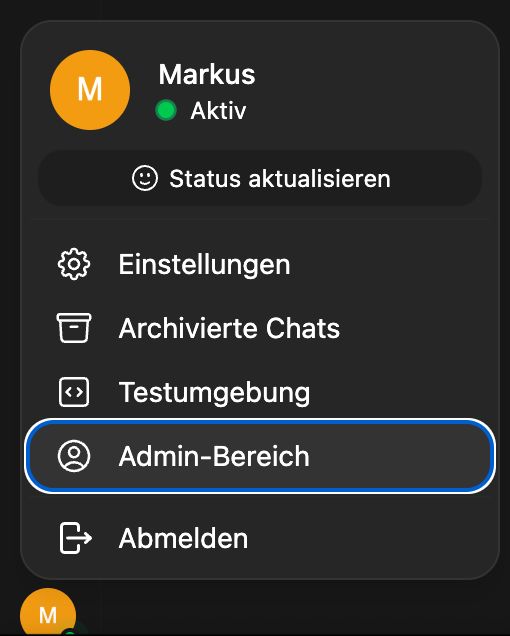

Die API ist standardmäßig aktiviert, überprüfen Sie dies jedoch in der Vorlagenkonfiguration:

Nachdem Sie dies getan haben, aktivieren Sie die API-Schlüsselerstellung für alle Benutzer:

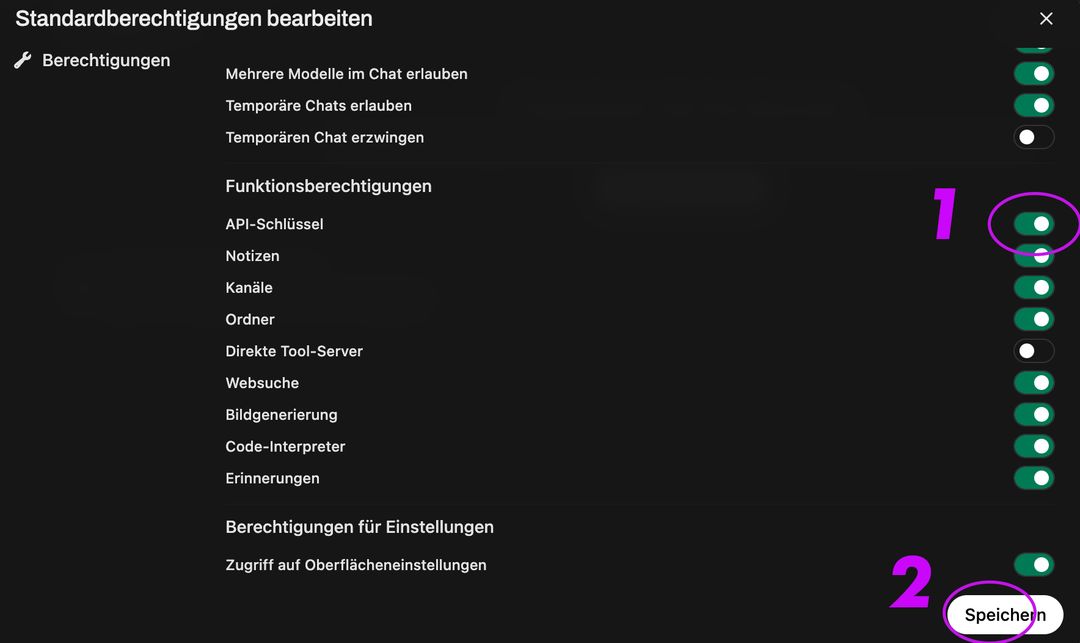

Gehen Sie dann zu Gruppe und Standardgruppe, aktivieren Sie die API-Schlüsselerstellung und klicken Sie auf Speichern:

Dies aktiviert den Endpunkt:

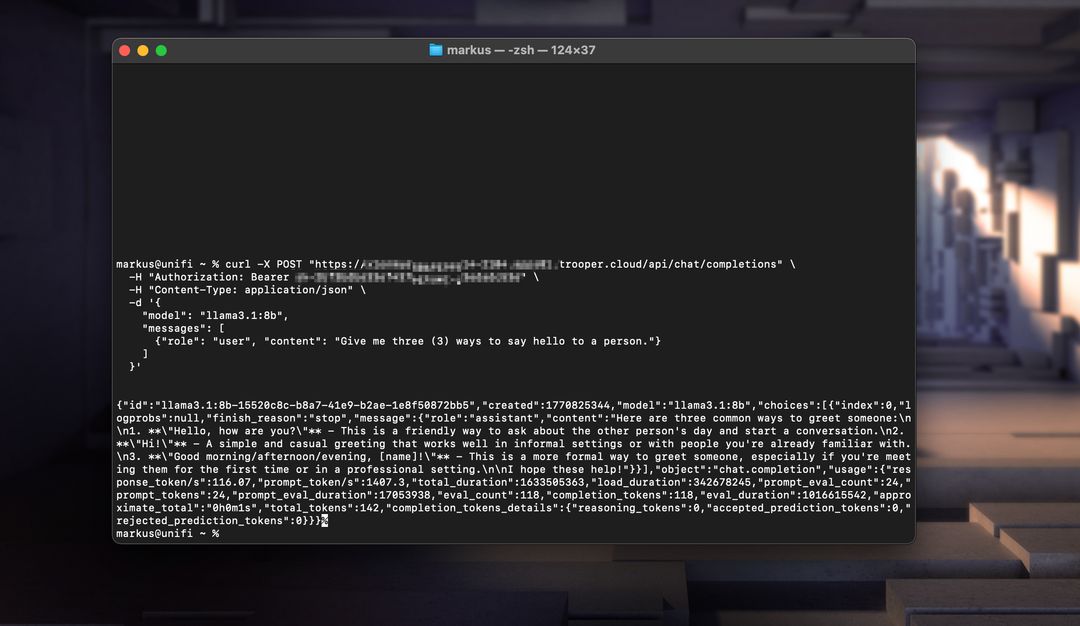

Im Folgenden finden Sie zwei funktionierende Beispiele: eines mit Node.js und das andere mit curl.

Node.js Beispiel

const axios = require('axios');

const response = await axios.post('https://your-secure-hostname.trooper.ai/api/chat/completions', {

model: 'llama3',

messages: [{ role: 'user', content: 'Hello, how are you?' }],

}, {

headers: {

'Content-Type': 'application/json',

'Authorization': 'Bearer YOUR_API_KEY'

}

});

console.log(response.data);

Stellen Sie sicher, dass API-Aufrufe /api/... und nicht /v1/... verwenden, da dies das erforderliche Format für OpenWebUI ist.

/api/...anstatt/v1/...da dies das erforderliche Format für OpenWebUI ist.

cURL Beispiel

curl https://your-secure-hostname.trooper.ai/api/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer YOUR_API_KEY" \

-d '{

"model": "llama3",

"messages": [

{ "role": "user", "content": "Hello, how are you?" }

]

}'

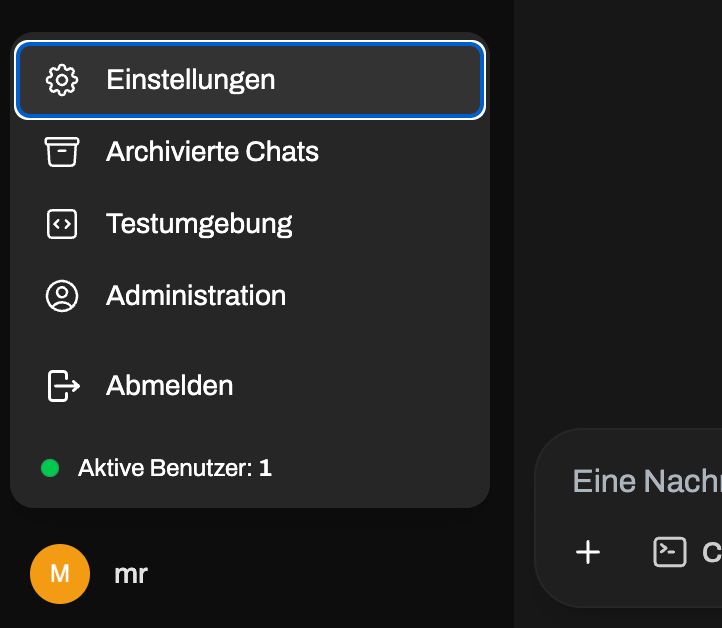

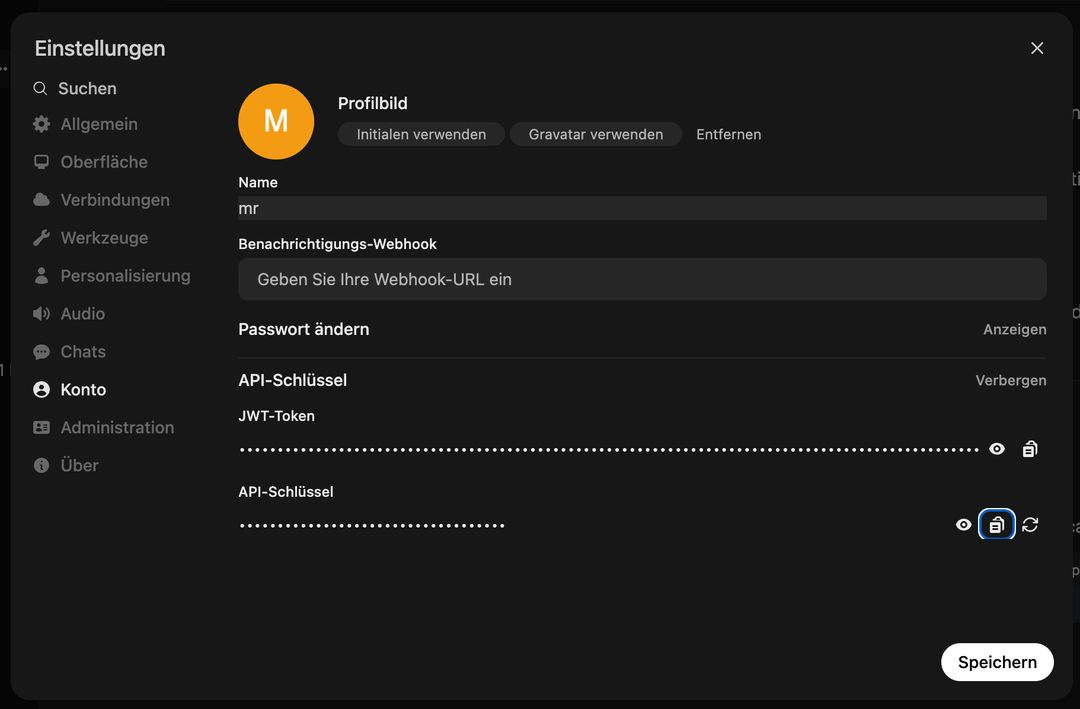

Ersetzen Sie IHR_API_SCHLÜSSEL durch den tatsächlichen Token, der im OpenWebUI unter Benutzer → Einstellungen → Konto → API-Schlüssel generiert wurde. Gehen Sie nicht ins Admin-Panel – der API-Zugriff ist benutzerspezifisch! Weitere Informationen finden Sie hier:

Gehen Sie danach hierher:

Sie können diese API mit Tools wie LangChain, N8N, FlowWise, NodeJS-OpenAI, LlamaIndex oder jeder Codebasis verwenden, die die OpenAI API-Spezifikation unterstützt.

Manuelle Aktualisierungen

Wenn Sie nicht über das Vorlagensystem aktualisieren möchten, können Sie jederzeit die folgenden Befehle ausführen, um sowohl OpenWebUI als auch Ollama zu aktualisieren:

# Update OpenWebUI:

# 1. Zum OpenWebUI-Verzeichnis wechseln

cd /home/trooperai/openwebui

# 2. Repository aktualisieren

git pull

# 3. Frontend-Abhängigkeiten installieren und neu bauen

npm install

npm run build

# 4. Backend: Python-Venv aktivieren

cd backend

source venv/bin/activate

# 5. Pip aktualisieren & Abhängigkeiten neu installieren

pip install --upgrade pip

pip install -r requirements.txt -U

# 6. OpenWebUI systemd-Dienst neu starten

sudo systemctl restart openwebui.service

# (optional) Update Ollama:

curl -fsSL https://ollama.com/install.sh | sh

sudo systemctl restart ollama.service

OpenWebUI deaktivieren

Falls Sie VRAM sparen möchten, können Sie OpenWebUI wie folgt deaktivieren:

sudo systemctl disable --now openwebui.service

Um OpenWebUI erneut zu aktivieren, führen Sie über das Terminal folgenden Befehl aus:

sudo systemctl enable --now openwebui.service

Support und weitere Dokumentation

Für Installationsunterstützung, Konfigurationshilfe oder Fehlerbehebung wenden Sie sich bitte direkt an den Trooper.AI Support:

- E-Mail: support@trooper.ai

- WhatsApp: +49 6126 9289991

Zusätzliche Ressourcen und erweiterte Konfigurationsanleitungen: