OpenWebUI i Ollama

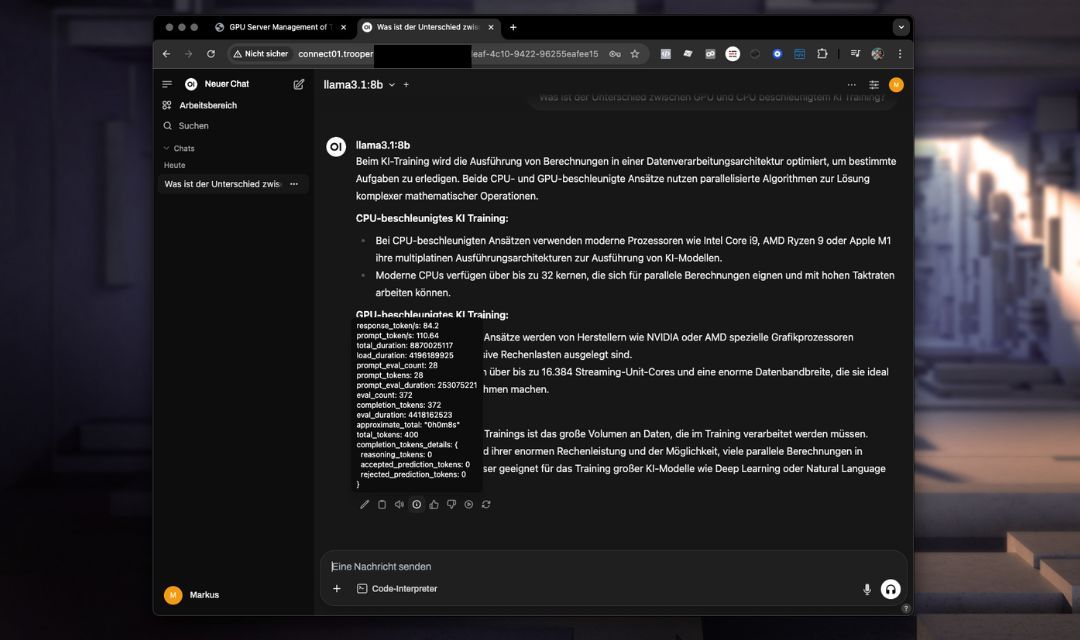

Szablon OpenWebUI & Ollama dostarcza gotowy do użycia interfejs czatu z sztuczną inteligencją w wersji samodzielnie hostowanej, zapewniając bezpośrednią integrację z potężnymi modelami językowymi takimi jak Llama lub DeepSeek za pośrednictwem Ollama . Zawiera on optymalne ustawienia dla płynnej pracy bez dodatkowej konfiguracji.

Ten szablon wykorzystuje zaawansowane możliwości API OpenWebUI, zapewniając udoskonalone zarządzanie konwersacjami, trwałość kontekstu i usprawnioną integrację w porównaniu z prostszym API Ollama.

Możesz określić wersję OpenWebUI do zainstalowania. Domyślna wartość to nasza ostatnio przetestowana wersja; jednak możesz ją zaktualizować lub obniżyć w razie potrzeby. Po prostu wprowadź żądaną wersję w wartości konfiguracyjnej podczas instalacji szablonu.

Kluczowe funkcje i możliwości

- Zaawansowane Interfejsy Webowe: Intuicyjne doświadczenie czatu dostępne bezpośrednio przez przeglądarkę.

- Rozszerzone możliwości API: Ulepsowane zarządzanie kontekstami czatu oraz łatwiejsza integracja z aplikacjami zewnętrznymi.

- Optymalne wykorzystanie modeli: Wstępnie zainstalowane modele gotowe do natychmiastowego użycia.

- Zintegrowane środowisko: Pełne wstępnie skonfigurowane środowisko obejmujące ustawienia portów oraz niezbędne konfiguracje.

- Bezpieczne i Dostosowywalne: Prosty proces konfiguracji uwierzytelniania oraz indywidualnych ustawień użytkownika.

Instalacja

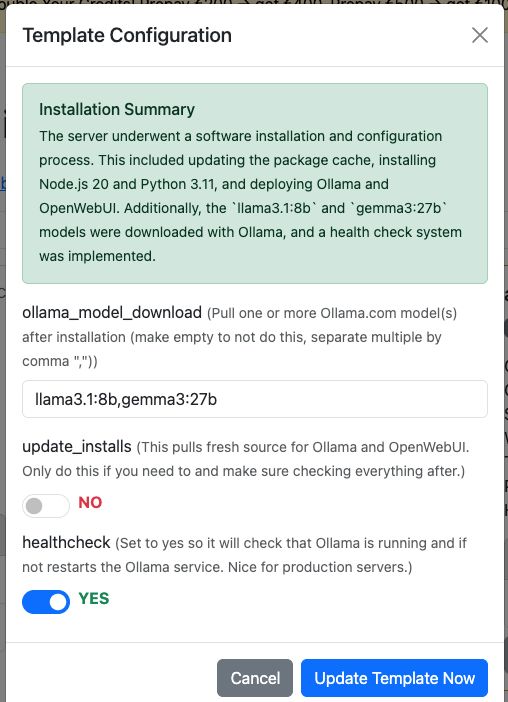

Wystarczy dodać szablon “OpenWebUI & Ollama” do swojego serwera GPU Trooper.AI, a instalacja przebiegnie całkowicie automatycznie. Jeśli chcesz, może również bezpośrednio pobierać modele z Ollama. Możesz je skonfigurować w oknie dialogowym Konfiguracji Szablonu.

Oczywiście, możesz nadal pobierać modele przez OpenWebUI po instalacji.

Dodatkowe opcje:

Aktualizacja instalacji:

Ta opcja pobiera najnowsze źródła dla Ollamy i OpenWebUI. Użyj jej tylko wtedy, gdy jest to konieczne, oraz upewnij się później, że wszystko działa poprawnie.

Oczywiście możesz również wykonać ręczne aktualizacje przez terminal, ale pamiętaj także o zainstalowaniu zależności.

Ta funkcja zajmie się tym za Ciebie – wygodne i automatyczne!Aktywuj Sprawdzanie Stanu (Health Check):

Ustaw to natak, aby włączyć sprawdzanie stanu, które zapewnia, że usługa Ollama działa i odpowiada przez wewnętrzne API.

Jeśli nie działa, sprawdzenie stanu automatycznie restartuje usługę.

Skrypt znajduje się pod ścieżką/usr/local/bin/ollama-health.sh, a sterowanie usługą odbywa się za pomocą:

sudo service ollama-health stop/start/status.

To jest szczególnie przydatne dla serwerów produkcyjnych.

Dostęp do OpenWebUI

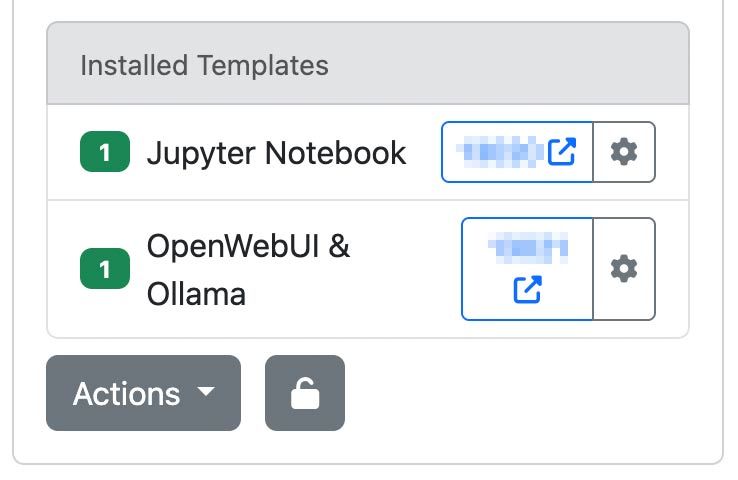

Po wdrożeniu instancji serwera Trooper.AI z szablonem OpenWebUI & Ollama, uzyskaj do niej dostęp za pomocą przypisanego adresu URL i portu:

http://your-hostname.trooper.ai:assigned-port

Lub kliknij na niebieski numer portu obok szablonu OpenWebUI:

Skonfigurujesz początkowe dane logowania przy pierwszym połączeniu. Upewnij się, że te dane są przechowywane w bezpiecznym miejscu, ponieważ będą wymagane do dalszego dostępu.

Zalecane przypadki użycia

Szablon OpenWebUI i Ollama jest idealny do:

- Współpraca zespołowa poprzez czat AI

- Wdrażanie osobistych asystentów AI

- Szybki rozwój i prototypowanie aplikacji konwersacyjnych AI

- Wykorzystanie API oraz budowanie/łączenie agentów jako zamiennik dla API OpenAI

- Cele edukacyjne i badania naukowe

Modele LLM, które warto przetestować

Z naszej perspektywy – oto kilka modeli, od których warto zacząć:

- GPT-OSS: Model o otwartych wagach OpenAI, nadający się do rozumowania, zadań agentycznych oraz rozwoju. Sprawdza się na instancjach Explorer, Conqueror (16 GB pamięci wideo) i Sparbox (24 GB pamięci wideo). https://ollama.com/library/gpt-oss:20b

- DeepSeek-R1: Model otwarty o wysokiej wydajności w zakresie rozumowania, porównywalny z O3 i Gemini 2.5 Pro. Zoptymalizowany dla maszyn StellarAI wyposażonych w 48 GB pamięci VRAM. https://ollama.com/library/deepseek-r1:70b

- Gemma 3: Obecnie jeden z najbardziej wydajnych modeli przeznaczonych do pracy na pojedynczej karty graficznej. Zasilany przez Trooper.AI’s James na instancjach Sparbox. https://ollama.com/library/gemma3:27b

Znajdź więcej modeli językowych tutaj: https://ollama.com/search (Wszystkie są kompatybilne z OpenWebUI!)

Kwestie techniczne

Wymagania systemowe

Upewnij się, że wykorzystanie VRAM przez model nie przekracza 85% pojemności, aby zapobiec znacznemu pogorszeniu wydajności.

- Zalecana pamięć VRAM GPU: 24 GB

- Pamięć: Co najmniej 180 GB wolnej przestrzeni

Prekonfigurowane środowisko

- Ollama i OpenWebUI są wstępnie zainstalowane i w pełni zintegrowane.

- Ustawienia portów i wszystkie niezbędne konfiguracje zostały już skonfigurowane, co eliminuje potrzebę dalszej ręcznej konfiguracji.

- Katalogi instalacyjne i zmienne środowiskowe są zdefiniowane wstępnie, aby umożliwić natychmiastowe użycie.

Trwałość danych

Wszystkie interakcje z czatem, konfiguracje modeli i ustawienia użytkownika są bezpiecznie przechowywane na Twoim serwerze.

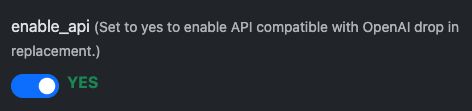

Połączenie przez API kompatybilne z OpenAI

OpenWebUI zapewnia interfejs API kompatybilny z OpenAI, umożliwiając bezproblemową integrację z narzędziami i aplikacjami obsługującymi format OpenAI. Pozwala to programistom na interakcję z modelami hostowanymi samodzielnie, takimi jak llama3 tak jakby komunikowali się z oficjalnym API OpenAI — idealne do osadzania sztucznej inteligencji konwersacyjnej w Twoich usługach, skryptach lub przepływach automatyzacji.

Pierwsze kroki: Przygotowanie

API jest domyślnie włączone, ale sprawdź w konfiguracji szablonu:

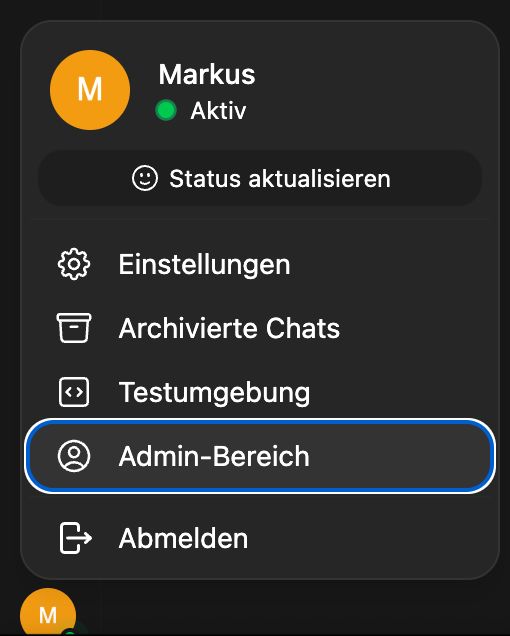

Po tym włącz tworzenie kluczy API dla wszystkich użytkowników:

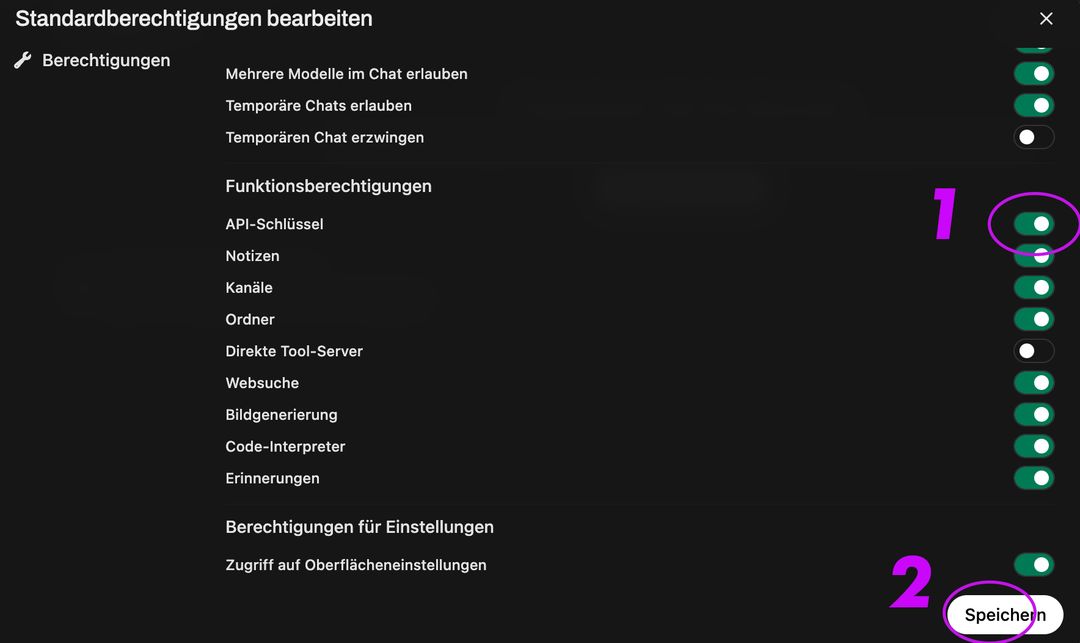

Następnie przejdź do Grupy i Domyślnej Grupy, aktywuj tworzenie klucza API, kliknij Zapisz:

To aktywuje punkt końcowy:

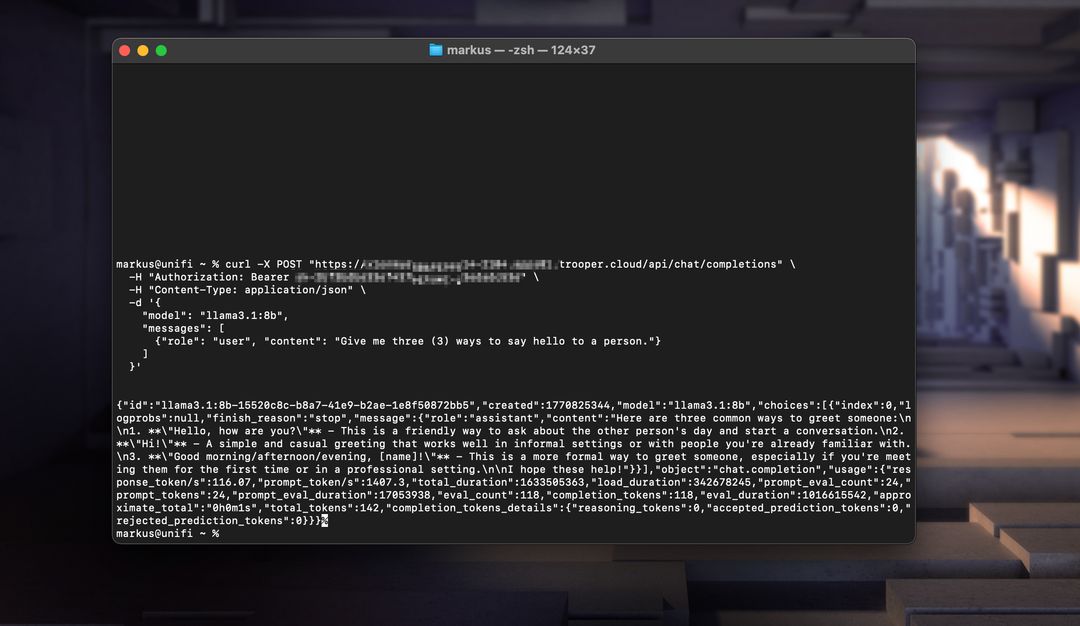

Poniżej znajdują się dwa przykłady: jeden wykorzystujący Node.js, a drugi używający curl.

Przykład Node.js

const axios = require('axios');

const response = await axios.post('https://your-secure-hostname.trooper.ai/api/chat/completions', {

model: 'llama3',

messages: [{ role: 'user', content: 'Hello, how are you?' }],

}, {

headers: {

'Content-Type': 'application/json',

'Authorization': 'Bearer YOUR_API_KEY'

}

});

console.log(response.data);

Upewnij się, że wywołania API wykorzystują

/api/...zamiast/v1/...ponieważ jest to wymagany format dla OpenWebUI.

Przykład cURL

curl https://your-secure-hostname.trooper.ai/api/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer YOUR_API_KEY" \

-d '{

"model": "llama3",

"messages": [

{ "role": "user", "content": "Hello, how are you?" }

]

}'

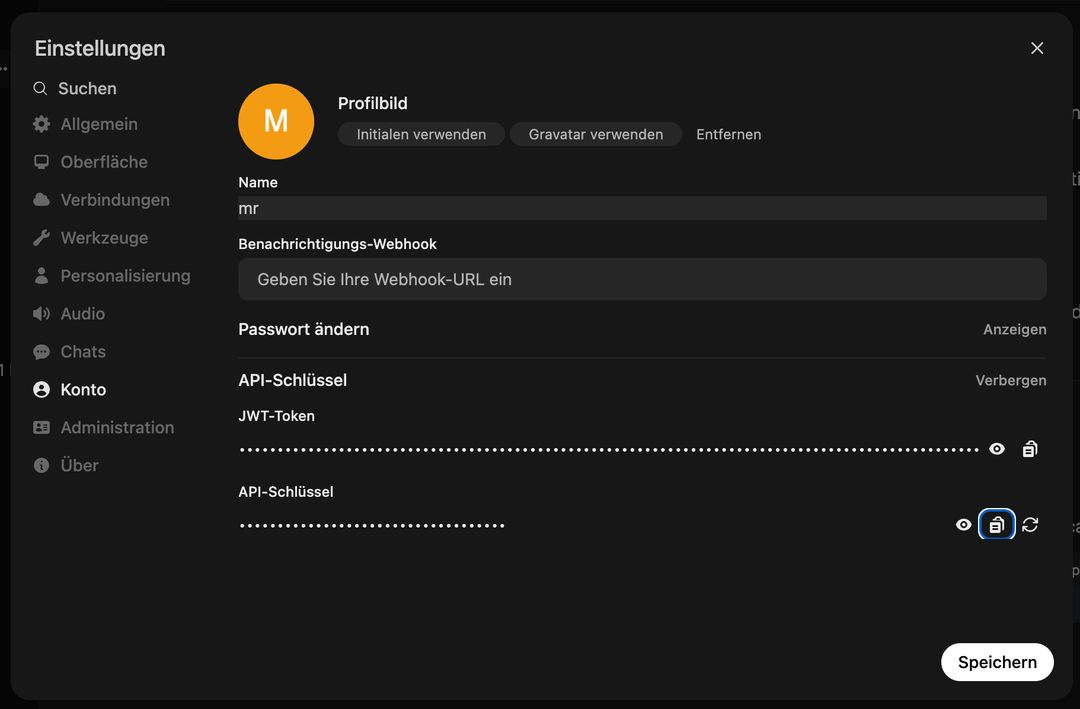

Zastąp YOUR_API_KEY rzeczywistym tokennem wygenerowanym w interfejsie OpenWebUI pod punktem Użytkownik → Ustawienia → Konto → Klucze API. Nie wchodź do panelu administracyjnego – dostęp do API jest indywidualny dla użytkownika! Sprawdź tutaj:

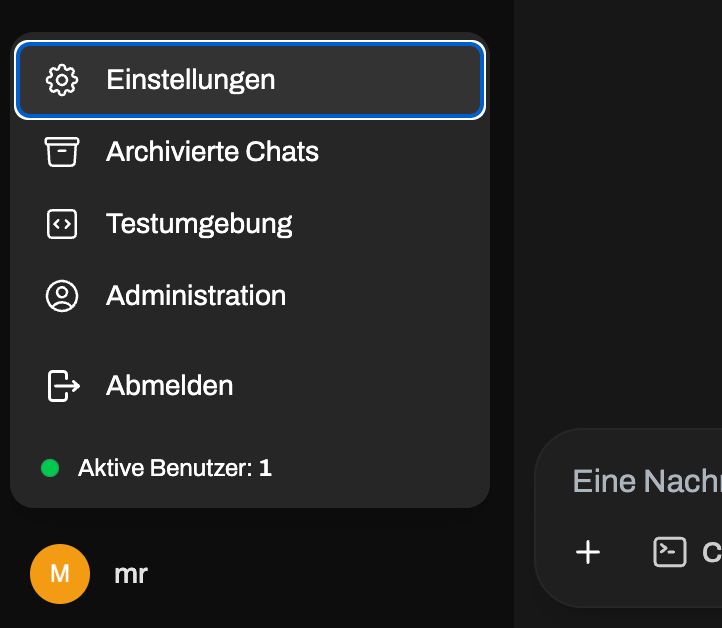

Po tym przejdź tutaj:

Możesz użyć tego API z narzędziami takimi jak LangChain, N8N, FlowWise, NodeJS-OpenAI, LlamaIndex, lub dowolnym kodem obsługującym specyfikację API OpenAI.

Aktualizacje ręczne

Jeśli nie chcesz aktualizować za pomocą systemu szablonów, możesz w dowolnym momencie uruchomić następujące polecenia, aby zaktualizować zarówno OpenWebUI, jak i Ollama:

# Update OpenWebUI:

# 1. Zum OpenWebUI-Verzeichnis wechseln

cd /home/trooperai/openwebui

# 2. Repository aktualisieren

git pull

# 3. Frontend-Abhängigkeiten installieren und neu bauen

npm install

npm run build

# 4. Backend: Python-Venv aktivieren

cd backend

source venv/bin/activate

# 5. Pip aktualisieren & Abhängigkeiten neu installieren

pip install --upgrade pip

pip install -r requirements.txt -U

# 6. OpenWebUI systemd-Dienst neu starten

sudo systemctl restart openwebui.service

# (optional) Update Ollama:

curl -fsSL https://ollama.com/install.sh | sh

sudo systemctl restart ollama.service

Wyłączanie OpenWebUI

Jeśli chcesz zaoszczędzić trochę VRAM, możesz wyłączyć OpenWebUI w ten sposób:

sudo systemctl disable --now openwebui.service

Aby ponownie włączyć OpenWebUI, uruchom w terminalu:

sudo systemctl enable --now openwebui.service

Wsparcie i dalsza dokumentacja

W razie potrzeby pomocy przy instalacji, konfiguracji lub rozwiązywaniu problemów, prosimy o bezpośredni kontakt z supportem Trooper.AI:

- E-mail: [email protected]

- WhatsApp: +49 6126 9289991

Dodatkowe zasoby i zaawansowane przewodniki konfiguracyjne: